La generación de video con IA es potente, pero las generaciones fallidas siguen siendo una de las mayores frustraciones. Un producto puede cambiar de forma de repente, una imagen de referencia puede ser ignorada, o un prompt detallado puede acabar en un video que solo sigue la idea general y no el plan de tomas real.

Por eso quise probar HappyHorse 1.0 desde un ángulo más práctico: ¿puede reducir ese tipo de errores que suelen hacerte perder tiempo, créditos y energía creativa?

En esta prueba práctica utilicé HappyHorse 1.0 de tres maneras distintas: primero con una sola imagen del producto DJI Pocket 3 para comprobar la consistencia del producto, luego con cinco imágenes de referencia para evaluar su comprensión multiángulo, y por último con un prompt de cafetería solo en texto para ver qué tan bien sigue indicaciones de cámara con múltiples tomas.

Prueba 1: Image-to-Video: consistencia del producto

Para comprobar si HappyHorse1.0 podía convertir una sola imagen del DJI Pocket 3 en un promo de 5 segundos apto para mostrar el producto, hice un experimento rápido.

Para ganar estabilidad, no me limité a lanzar la foto del producto directamente al modelo y esperar suerte. Primero usé GPT Image 2 para generar una imagen publicitaria más pulida, luego utilicé esa imagen como primer fotograma del video y finalmente la pasé a HappyHorse1.0 para generar el clip de 5 segundos.

Abrí en el navegador la página AI Video Generator de Lanta AI y elegí el modo Image to Video en el panel izquierdo. Después subí la imagen de referencia del DJI Pocket 3 generada con GPT Image 2. En la interfaz se ve que HappyHorse1.0 admite hasta 9 imágenes de referencia, aunque en esta prueba solo cargué una.

Luego escribí el siguiente prompt en la caja de texto. Un detalle importante: el prompt debe mantenerse por debajo de 1000 caracteres.

Mantén el diseño del producto lo más fiel posible al DJI Pocket 3 real. No rediseñes la lente, el gimbal, la pantalla, los botones, la forma del cuerpo, la ubicación del logo ni las proporciones. Conserva la estructura original del producto durante todo el video.

Crea un teaser vertical de 5 segundos para DJI Pocket 3. Mantén el producto centrado, nítido y muy preciso en todo momento. No rediseñes el producto ni cambies la lente, el gimbal, la pantalla, los botones o las proporciones del cuerpo.

Movimiento de cámara: empieza con una toma media-abierta del producto y luego haz un acercamiento lento hacia la lente.

Iluminación: usa iluminación de estudio dramática con contraluz azul frío y un reflejo blanco suave recorriendo la mitad inferior del cuerpo del producto.

Fondo: fondo oscuro, minimalista y futurista con sutiles trazos de luz azul y reflejos brillantes en el suelo. Estilo: anuncio tecnológico premium, escaparate cinematográfico de producto, look limpio de ecommerce y movimiento suave.Para la configuración del video elegí:

- Modelo: HappyHorse1.0

- Duración: 5 s

- Formato: 9:16

- Calidad: 1080P

Esta generación cuesta alrededor de 175 créditos. Cuando todo estuvo listo, hice clic en Generate para iniciar el proceso. En la práctica esperé unos 3-4 minutos y obtuve un promo del DJI Pocket 3 con este aspecto.

En el resultado final, el DJI Pocket 3 se mantiene justo en el centro del encuadre. El fondo negro, las estelas de luz azul, los reflejos fríos y el suelo espejado funcionan muy bien para reforzar esa sensación tecnológica que esperas en un producto de imagen digital como el DJI Pocket 3.

Durante todo el video, la forma y las proporciones de la cámara se mantienen estables. La lente, el gimbal y la pantalla permanecen en sus posiciones correctas, y el logo también se ve con claridad. No hay distorsiones evidentes del producto ni ese típico rediseño extraño estilo IA.

Al mismo tiempo, el movimiento de cámara es muy fluido. Hay un acercamiento claro que dirige la atención del espectador hacia las partes clave del producto.

Prueba 2: generación de video con múltiples imágenes de referencia

Después quise llevar la prueba un paso más allá y ver qué tal maneja HappyHorse 1.0 la generación de video con múltiples referencias. Esta vez subí cinco imágenes del DJI Pocket 3 desde distintos ángulos, incluyendo una vista frontal, varios ángulos laterales, una vista en mano y una vista trasera. El objetivo era ver si el modelo podía entender el mismo producto desde varias perspectivas y reunir esas vistas en un solo video generado. También quería comprobar si el video podía mostrar con naturalidad el frente, el lateral y la parte trasera del producto mientras la cámara se movía.

Después repetí el mismo flujo de trabajo: escribí el prompt, ajusté los parámetros y generé el video. Este fue el resultado.

En el resultado final, la toma se desplaza lentamente desde la vista frontal hacia el lateral, luego revela la parte trasera e incluso una vista tipo handheld del DJI Pocket 3, lo que hace que todo se sienta como una demostración completa del producto. No necesitas fotografiar el producto manualmente desde todos esos ángulos ni editar el metraje por tu cuenta.

A partir de las imágenes de referencia, el generador de video con IA puede crear automáticamente un clip corto con transiciones suaves y cambios de ángulo. Esto resulta especialmente útil para anuncios de ecommerce, teasers de producto y videos cortos para redes sociales.

Prueba 3: precisión del prompt de texto y movimiento multi-shot

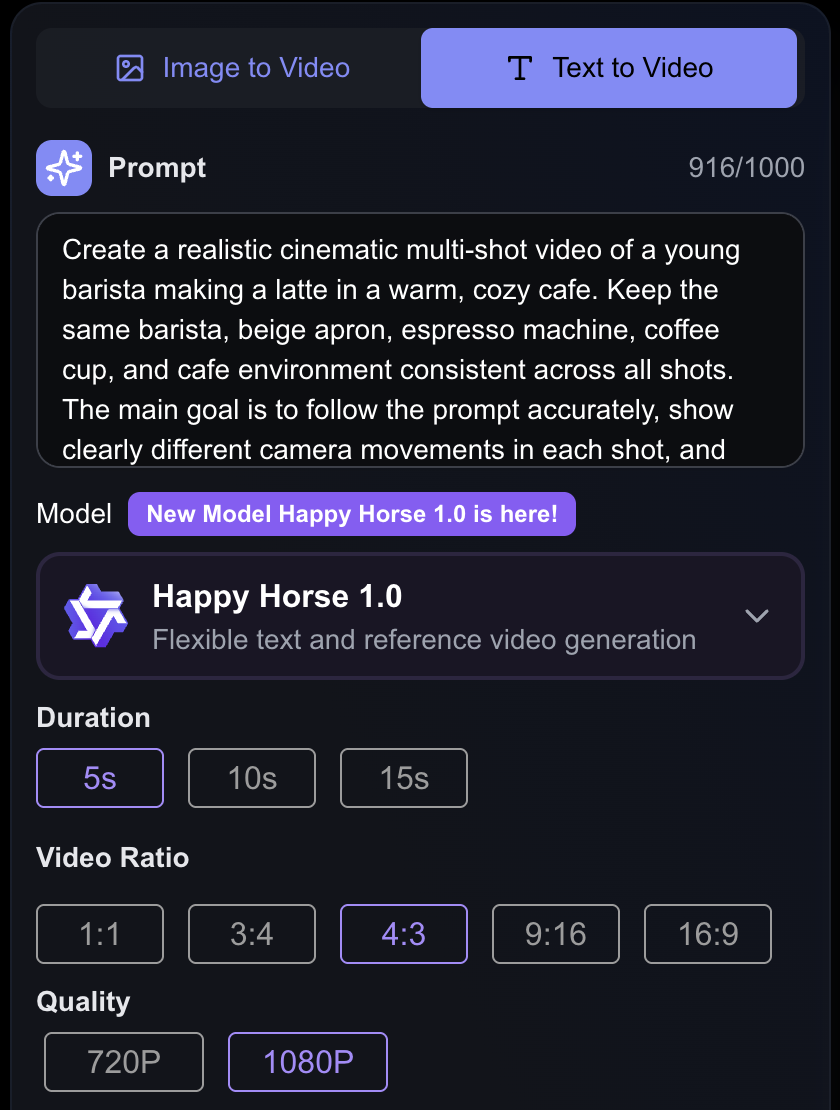

Para el experimento final utilicé solo text-to-video para probar la precisión del prompt de texto y el movimiento multi-shot de HappyHorse 1.0. En la caja de texto introduje el siguiente prompt:

Crea un video realista, cinematográfico y de múltiples tomas de un joven barista preparando un latte en una cafetería cálida y acogedora. Mantén al mismo barista, el delantal beige, la máquina de espresso, la taza y el entorno de la cafetería consistentes en todas las tomas. El objetivo principal es seguir el prompt con precisión, mostrar movimientos de cámara claramente distintos en cada toma y mantener transiciones suaves y naturales entre ellas.

Toma 1: plano general de establecimiento de la cafetería, con el joven barista frente a la máquina de espresso. Usa un movimiento de cámara lento tipo dolly-in.

Toma 2: plano medio lateral con ligero tracking, mostrando al barista encajando el portafiltro en la máquina e iniciando la extracción del espresso.

Toma 3: primer plano del espresso cayendo en la taza, seguido del vertido de leche para empezar el latte art.

Toma 4: toma cenital o hero shot del latte terminado sobre una mesa de madera, con el latte art bien visible y un movimiento sutil en órbita o un elegante desplazamiento superior.

Para la configuración del video elegí:

- Modelo: HappyHorse1.0

- Duración: 5 s

- Formato: 4:3

- Calidad: 1080P

Text-to-video tarda bastante más que image-to-video. Esperé unos 5 minutos y obtuve un video así: un barista preparando café en una cafetería.

No le di a HappyHorse 1.0 ninguna imagen de referencia, así que tanto el personaje como el escenario fueron completamente imaginados por el modelo. Aun así, en términos de precisión del prompt, el resultado fue bastante sólido. Aparecen la atmósfera cálida de la cafetería, el joven barista, el delantal, la máquina de café, la taza y el proceso de preparación del latte, y en conjunto el video se mantiene en tema sin desviarse demasiado.

Lo que más me gustó fue lo bien que HappyHorse 1.0 entendió la estructura de planos del prompt. En el video final se aprecia claramente la capa de tomas distintas: un plano general, un plano medio lateral, un primer plano y una toma cenital o hero shot. Consiguió cambiar entre varios planos en solo 5 segundos.

Para mí, esta prueba muestra una de las mayores fortalezas de HappyHorse 1.0: puede entender una planificación de tomas relativamente compleja, crear transiciones suaves e intentar organizar esos planos dentro de un único video coherente.

Lo que todavía le cuesta a HappyHorse 1.0

Dicho esto, después de probarlo no diría que HappyHorse 1.0 pueda generar un video final perfecto y listo para publicar en todos los intentos. Su apartado visual y su capacidad para seguir una planificación de planos pueden ser realmente impresionantes, pero cuando el video involucra productos reales, primeros planos humanos o movimiento continuo más largo, todavía conviene revisar el resultado con cuidado.

Por ejemplo, en videos de producto el modelo puede rediseñar pequeños detalles, así que el resultado no siempre será idéntico al producto real. Con videos de personas ocurre algo parecido. Los clips cortos suelen ser más estables, pero si el movimiento se vuelve más complejo o la toma dura más, aún pueden aparecer pequeños cambios en el rostro, las manos, la ropa u otros detalles.

¿Para quién funciona mejor HappyHorse 1.0?

Creadores de video corto

Si haces TikToks, Reels, Shorts o anuncios para redes, HappyHorse 1.0 merece una prueba.

El video corto necesita hooks rápidos, visuales potentes, formatos verticales y variaciones ágiles. Ahí es donde HappyHorse 1.0 encaja mejor.

No está pensado para contar una historia completa de principio a fin. Funciona mejor creando un momento visual fuerte: un close-up de producto, un movimiento cinematográfico, una toma teaser o un clip capaz de frenar el scroll.

Marcas de ecommerce

HappyHorse 1.0 también encaja bien en equipos de ecommerce.

La mayoría de las marcas ya tienen fotos de producto. Lo que muchas veces falta es suficiente contenido en video para anuncios, landing pages, páginas de producto y redes sociales.

Con la imagen de referencia adecuada, una sola foto de producto puede convertirse en un teaser vertical, una demo de estudio, un borrador lifestyle o un recurso con movimiento para una product page.

Eso lo hace útil cuando necesitas muchas variaciones creativas pero no quieres fotografiar cada idea desde cero.

Creativos publicitarios

Para quienes crean anuncios, el valor principal es la velocidad.

Antes de construir una campaña completa, necesitas probar hooks, escenas, productos, estilos y formatos.

HappyHorse 1.0 ayuda justo en esa fase temprana. Te permite ver si una dirección visual tiene potencial antes de invertir más tiempo en edición, producción o acabado de campaña.

Concept artists y creadores de storyboard

HappyHorse 1.0 también puede ayudar en la planificación visual.

Si tienes un fotograma estático, un concepto de producto o una imagen de storyboard, puede convertir ese still en una vista previa en movimiento.

Eso ayuda cuando necesitas presentar una escena, planificar una campaña o comprobar si una idea funciona en movimiento. No sustituirá a un flujo de producción completo, pero sí puede acelerar y hacer más visual la fase temprana de concepto.

Conclusión

Después de estas tres pruebas, HappyHorse 1.0 se siente como una opción sólida para reducir parte de los fallos más comunes en generación de video con IA.

No es un botón mágico que garantice un video perfecto en cada intento, pero sí muestra un potencial claro para creadores que valoran la precisión del producto, el control del prompt y transiciones de plano más fluidas.

Si quieres probar el mismo flujo, puedes usar Lanta AI y su AI Video Generator para probar HappyHorse 1.0 con image-to-video, generación por múltiples referencias y text-to-video directamente en el navegador.

O puedes entrar directamente en la página del modelo HappyHorse 1.0 para comparar su posicionamiento con el resto de modelos de video de Lanta AI.