text to video artificial intelligence 可以把书面提示词直接转换成短视频。你不需要拍摄场景,只要描述你想看到什么,模型就会据此生成运动、镜头、风格和场景细节。

这已经不再只是一个新奇演示,而是正在变成真正可用的 AI 创作工作流。OpenAI 将 Sora 描述为可根据自然语言或图像生成细节丰富视频和音频的模型;Google 将 Veo 定位为具备更强创意控制能力的视频生成模型;Runway 也在其文档中强调围绕场景、运动和镜头语言来写提示词。

快速回答

text to video artificial intelligence 的工作方式,是先理解你的书面提示词,再合成与之匹配的视频片段。实际过程中,这类系统会解析主体、动作、场景、镜头运动、风格和情绪,然后生成尽可能贴合请求的一系列画面。

核心要点

- Text-to-video AI 可以根据书面提示词生成视频片段。

- 提示词质量很重要,因为模型需要明确知道主体、运动、风格和镜头行为。

- 成熟工作流通常是迭代式的:生成、查看、优化、再生成。

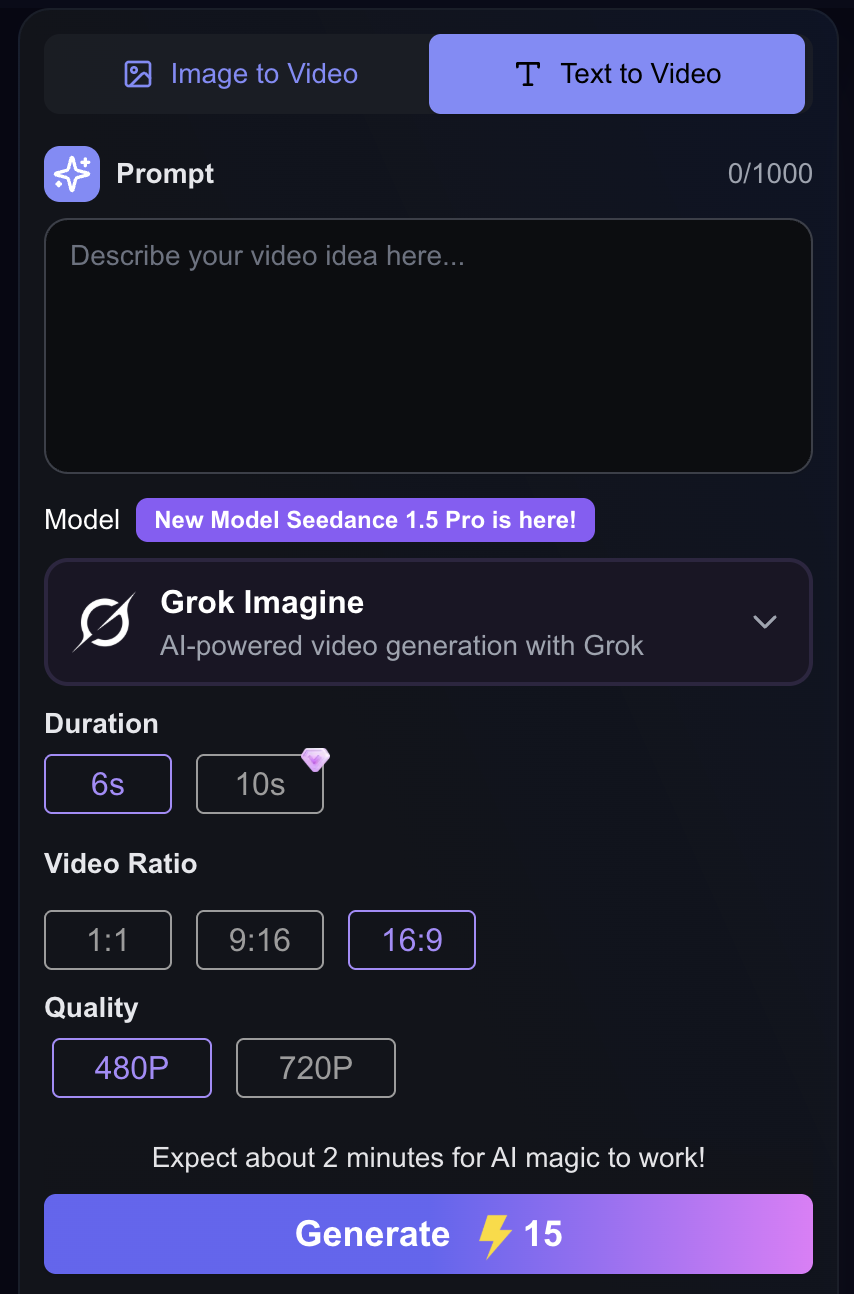

- Text to video 从文字开始,而 image to video 从已有图片开始。

什么是 text to video artificial intelligence?

text to video artificial intelligence 是一种生成式 AI,可以根据文字说明来创建视频。比如你输入“日出时分,雪山上空的电影感无人机镜头”,模型就会尝试生成与这段描述相匹配的视频片段。

这种工作流和 image to video、video to video 等模式并列存在。之所以重要,是因为有些创作者从文字创意开始,而另一些人已经有参考图,希望把它动起来。如果用户还处于探索阶段,text to video 往往是更自然的起点。

从提示词到结果

一个简单的理解框架

提示词

描述主体、动作、风格以及镜头方向。

AI 模型

模型负责理解运动、构图和场景连续性。

视频输出

你查看结果、优化提示词,再次生成。

Text to video AI 实际是如何工作的?

从高层来看,模型会先理解你的提示词。它会尝试识别主体、环境、动作、视觉风格、镜头方向和氛围,然后生成一系列符合这些要求的画面,并尽量保持时间上的连贯性。

这就是为什么提示词质量会直接影响结果。提示词越模糊,模型就越需要自己猜;提示词越清晰地定义了主体、场景、动作、风格和镜头,结果通常就越接近你的真实预期。

主体

视频里出现的是谁,或者是什么。

环境

场景发生在哪里,以及周围的视觉背景是什么。

动作

在这段镜头中,什么在运动、变化或表演。

风格

结果应该偏电影感、动画感、极简、写实还是商业质感。

镜头

镜头应当平移、推进、漂移、固定,还是带有手持感。

连续性

场景在前后帧之间能否保持稳定和连贯。

输入提示词之后会发生什么?

大多数 text-to-video 工作流都遵循同一个循环:写提示词、生成第一版、查看结果、优化提示词,再继续生成或编辑。这不是权宜之计,而是这类工具的正常使用方式。

写提示词

尽可能清楚地描述主体、场景、运动、风格和镜头行为。

生成第一版

模型会把提示词转成一段包含运动和场景结构的短视频。

查看输出

检查运动质量、构图、场景连贯性,以及氛围是否符合预期。

优化提示词

如果结果跑偏,就收紧动作描述、简化场景,或补充镜头与风格信息。

再次生成或继续编辑

实际效果通常来自几轮迭代,而不是第一次就完美。

试试 AI Text to Video

把文字提示词变成短视频,对比不同提示词结构的效果,并在 Lanta AI 工具页里把理论直接变成真实输出。

Text to video artificial intelligence 可以用来做什么?

对小团队而言,最大的优势通常是速度。你不必先准备完整拍摄计划,而是可以直接用文字测试视觉方向。因此,text-to-video AI 很适合用来做概念视频、广告草案、社媒短片、产品预告、解释型内容和创意实验。

电影感

更强调景别、运动和光线的提示词风格。

动画感

用更简单的视觉语法来控制角色运动。

产品导向

适合做产品展示的棚拍式镜头语言。

为什么提示词这么重要?

Text-to-video 模型只能根据你给出的指令工作。因此,一个更强的提示词通常会包含主体、场景、动作、视觉风格、镜头运动以及情绪氛围。描述越具体,模型就越不需要替你脑补。

较弱的提示词

a dog in a park

模型必须自行猜测犬种、光线、动作、镜头角度、时间和情绪氛围。

更强的提示词

a golden retriever running through a sunlit park at golden hour, cinematic slow motion, shallow depth of field, soft warm lighting, handheld camera feel

这个版本明确给出了主体、运动、风格、构图和光线方向。

可复用的提示词示例

电影感

"Wide aerial drone shot over misty mountain valleys at sunrise, soft fog drifting, slow forward camera movement, volumetric light rays, ultra-realistic, calm atmosphere."

为什么有效: 清晰定义了场景、光线、运动和镜头方向,更容易让模型稳定搭好整段镜头。

动画感

"Cute 2D mascot character waving to the camera, bright flat colors, smooth loop animation, simple clean background, friendly vibe."

为什么有效: 更窄的风格范围和更简单的运动目标,有助于减少漂移并保持画面易读。

产品广告

"Close-up of a black wireless earbud rotating on a glossy table, neon reflections, macro depth of field, seamless loop, studio lighting."

为什么有效: 单一主体、明确灯光和循环要求,通常更容易生成稳定的产品展示片段。

Text to video vs image to video

Text to video 从文字开始,image to video 从图片开始并让它动起来。两者都重要,但对应的是不同的工作方式和搜索意图。

| 模式 | 起点 | 最适合 | 为什么会选择它 |

|---|---|---|---|

| 文字生成视频 | 一段书面提示词 | 创意探索、快速概念验证,以及没有素材时的工作流 | 你想从一个想法直接走到动态画面,而不是先准备图片素材。 |

| 图片生成视频 | 上传图片或参考帧 | 更强的视觉控制、角色一致性,以及已有素材的动画化 | 你已经知道场景应该长什么样,只想让它动起来。 |

如果你已经确定了场景外观,image to video 通常会给你更强的视觉控制;如果你还在从零探索创意,text to video 往往是更合适的起点。

Text to video AI 的主要限制是什么?

即使是很强的模型也仍有边界。复杂物理交互、完美一致性、极精确的场景控制,以及长剧情连续性,依然可能比较困难。实际使用时,更合理的预期是持续迭代,而不是把第一次生成结果当作最终成片。

复杂的物理交互依然可能显得不可靠。

长叙事连续性比单场景短片更难做好。

精确的场景控制和角色一致性通常需要多轮迭代。

提示词塞得太满,反而可能带来歧义,而不是更强控制。

如何让 text to video AI 生成更好的结果

提升效果最简单的方法,是像导演一样思考,而不是像关键词堆砌者一样思考。描述观众应该先看到什么、什么该动、镜头该怎么动,以及画面应该传递什么情绪。

导演式思路

- 观众第一眼应该注意到什么?

- 场景中的主要运动是什么?

- 镜头应该保持静止还是移动?

- 这段视频应该传达什么情绪?

实用的新手工作流

先描述观众应该看到什么,而不只是主题词。

明确什么要动,什么要保持稳定。

只有真的需要镜头语言时才写镜头语言。

如果一致性比丰富度更重要,就把场景收窄。

每次只调整一点提示词,再重新生成,而不是整段全部重写。

亲自试试 text to video

如果你想从理论走向实践,最直接的下一步就是试一个真实工具。你可以试试 Lanta AI 的 text to video 工具,把书面提示词转换成短视频,并观察不同提示词结构如何影响结果。

为什么这里适合放 CTA

搜索“text to video artificial intelligence”的用户,通常先想理解这个概念。一旦他们明白了工作原理,往往就已经接近愿意尝试工具的阶段。这也是为什么这个主题天然适合作为信息型搜索到产品页之间的桥梁。

最后总结

Text to video artificial intelligence 的核心机制,是把书面提示词翻译成生成式视频片段,模型需要理解主体、运动、场景结构、风格和连续性。

最重要的结论很简单:text-to-video AI 已经不再只是实验性玩具。它正在成为原型验证、社媒内容创作、场景探索和加速创意生产的实用工具。

如果你想直接体验,最好的起点就是工具页。

读完这篇解析后,Lanta AI 的 AI text to video 工具 是最清晰的下一步。

常见问题

试试 AI Text to Video

把文字提示词变成短视频,对比不同提示词结构的效果,并在 Lanta AI 工具页里把理论直接变成真实输出。