Seedance 2.0 nos impresionó, pero no por la razón que suelen sugerir la mayoría de los videos demo.

La parte más interesante no fue la calidad de video en sí. Fue el control. En nuestras pruebas, Seedance 2.0 siguió mejor la dirección de cámara, aprovechó mejor las referencias visuales y convirtió un storyboard simple en un video que se sentía más planificado que aleatorio.

En eso, Seedance 2.0 se acerca más que muchos modelos de video que dependen solo del prompt. Pero también mostró límites que los creadores no deberían pasar por alto. Una prueba hizo que su control pareciera muy convincente. Otra dejó claro que su física todavía se siente artificial.

Sigue leyendo y verás qué hace bien Seedance 2.0, dónde empieza a fallar y si de verdad resulta útil para creadores de video.

¿Qué es Seedance 2.0?

Seedance 2.0 es un modelo de video con IA de ByteDance Seed. Ayuda a los creadores a producir videos con IA más fáciles de controlar, más realistas y más cercanos a necesidades reales de producción.

A diferencia de un modelo básico de texto a video, puede usar texto, imágenes, clips de video y audio como referencias, de modo que el creador puede guiar con más precisión al sujeto, el movimiento de cámara, el estilo, el ritmo y el sonido.

From Seedance 1.0 to Seedance 2.0

| Versión | Qué añadió | Cómo ayudó a la siguiente versión |

|---|---|---|

Seedance 1.0 | Inició la serie de modelos de video Seedance | Le dio al modelo la capacidad básica de crear clips cortos de video con IA |

Seedance 1.5 | Mejoró la sincronización entre audio y video | Hizo que sonido e imagen trabajaran juntos de forma más natural |

Seedance 1.5 Pro | Mejoró la generación de imagen a video y de audio | Construyó una base más sólida para obtener video de mayor calidad y más estabilidad |

Seedance 2.0Actual | Integró texto, imágenes, video y audio en un solo flujo de trabajo | Combinó referencias, edición, continuación de video, generación multishot y sonido nativo en una herramienta de creación de video con IA más completa |

Aspectos destacados de Seedance 2.0

Seedance 2.0 destaca en escenas complejas, con mayor estabilidad de movimiento y una física más creíble. Funciona especialmente bien en interacciones entre varias personas y en escenarios de movimiento complejo, produciendo más clips que los creadores pueden usar de verdad.

Por ejemplo, en una rutina completa de patinaje artístico en pareja, el modelo puede generar saltos sincronizados, rotaciones en el aire y aterrizajes precisos manteniendo una sensación física convincente de principio a fin. Eso ayuda a reducir muchos de los errores de física habituales en videos generados por IA de generaciones anteriores.

- Control por referencias multimodales. El usuario puede aportar hasta 9 imágenes, 3 clips de video y 3 clips de audio, además de instrucciones en lenguaje natural. El modelo usa esas referencias para guiar la composición, el movimiento, el lenguaje de cámara, los efectos visuales y el sonido. Incluso puede apoyarse en storyboards en texto como referencia creativa.

- Más control sobre el video final. Ofrece mejor seguimiento de instrucciones, mejor consistencia, extensiones de video más estables y edición dirigida. Los creadores pueden hacer cambios precisos sobre clips, personajes, acciones o líneas narrativas concretas. Además incorpora planificación de cámara guiada por prompt, lo que ayuda a construir planos con movimientos de cámara, encuadres y flujo visual más claros.

- Generación de audio estéreo de doble canal. Permite salida simultánea de varias pistas, incluyendo música de fondo, efectos ambientales y narración de personajes. Estos elementos de audio pueden alinearse con el ritmo visual de la escena, haciendo que el clip final se sienta más pulido, inmersivo y mejor sincronizado.

- Salida multishot de alta calidad de hasta 15 segundos. En una sola generación puede crear hasta 15 segundos de video con varios planos y sonido, dando a los creadores más margen para construir momentos visuales completos en lugar de simples muestras cortas de movimiento.

Prueba de storyboard y movimiento de cámara

Empezamos con un partido de fútbol porque es una buena prueba para la interacción entre varios sujetos. La escena pide que el equipo azul complete cinco pases conectados, atraviese la defensa del equipo rojo y termine marcando.

Aunque suena complejo, la acción puede dividirse en momentos claros. Un plano puede centrarse en el primer pase, el siguiente puede seguir al receptor y otro puede mostrar la reacción de los defensores. La cámara tiene que seguir el balón, a los jugadores y al cambio de foco de la jugada.

En la primera prueba no le dimos al modelo un storyboard detallado ni instrucciones específicas de cámara. Queríamos ver hasta qué punto podía resolver la secuencia por sí solo antes de añadir más control.

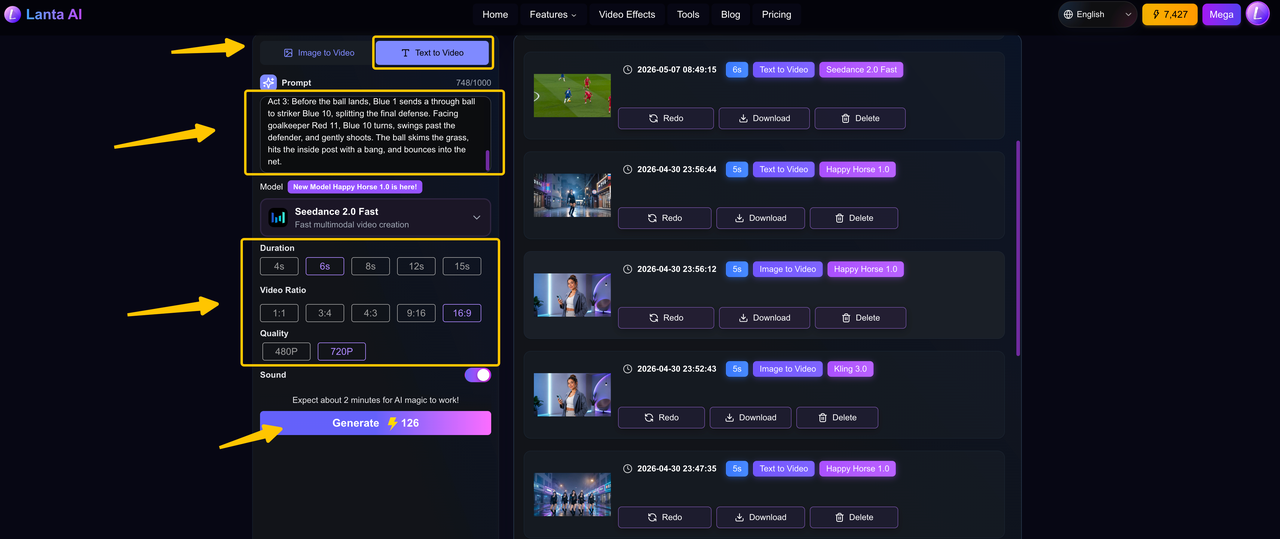

Primer intento sin dirección detallada de planos

Football match. Blue team faces strong red defenders, completes five precise passes, then scores.

Act 1: Blue 8 is pressed by Red 3 and calmly passes to Blue 6. Blue 6 instantly sends a diagonal long ball to sprinting right winger Blue 7.

Act 2: Near the baseline, Blue 7 stops, cuts back to avoid Red 9's sliding tackle, then pushes the ball toward the penalty arc. Red 1 and Red 2 close in. Blue 7 flicks the ball through Red 2's legs back to the advancing Blue 1.

Act 3: Before the ball lands, Blue 1 sends a through ball to striker Blue 10, splitting the final defense. Facing goalkeeper Red 11, Blue 10 turns, swings past the defender, and gently shoots. The ball skims the grass, hits the inside post with a bang, and bounces into the net.Resultado

En conjunto, el resultado fue bueno. El dorsal 10 del equipo azul sí completó el remate final, pero la secuencia completa de pases no se reprodujo entera. En lugar de cinco pases claramente conectados, el video mostró solo unos tres.

En la parte central, varias acciones que originalmente correspondían al número 7 y al número 1 del equipo azul terminaron siendo ejecutadas por el número 10. Tampoco se mostró con claridad el duelo entre el número 7 azul y los defensores rojos, así que esa parte de la jugada se sintió menos detallada de lo que describía el prompt.

Aun así, conviene insistir en que era la primera generación. No hicimos varias versiones ni escogimos la mejor. Llegar a este nivel en el primer intento ya resulta llamativo, incluso con sus fallos.

El storyboard y el movimiento de cámara no estaban mal, pero tampoco tenían un estilo muy marcado. Puede que esa fuera la forma en la que el modelo decidió jugar sobre seguro ante una tarea con mucha densidad de información.

Añadimos más detalle de storyboard y lenguaje de cámara

Después probamos qué pasaba al añadir instrucciones más detalladas de storyboard y movimiento de cámara.

In a football match, facing strong red-team players, the blue-team players complete five precise passes and finally score.

Act 1: Opening the Play - Passes 1-2

Shot 1 - Medium Shot: At the center of the frame, Blue No. 8 faces pressure from Red No. 3 and calmly passes the ball with the inside of his foot to Blue No. 6, who drops back to receive it.

Shot 2 - Wide Shot: After receiving the ball, Blue No. 6 does not hold onto it. He immediately sends a precise diagonal long pass. The ball draws a beautiful arc through the air and lands accurately at the feet of Blue No. 7, the right winger sprinting forward.

Act 2: Breaking Through the Defense - Passes 3-4

Shot 3 - Close-up / Tracking Shot: Near the baseline, Blue No. 7 suddenly stops and cuts the ball back, avoiding a sliding tackle from Red No. 9, then pushes the ball toward the top of the penalty arc.

Shot 4 - Low Angle: Two defenders, Red No. 1 and Red No. 2, move in to double-team him. Blue No. 7 lightly flicks the ball, sending it through Red No. 2's legs and back to Blue No. 1, who is rushing forward to complete the combination.Resultado

Esta vez el modelo siguió el prompt casi por completo y sí mostró capacidad multishot. El plano abierto del pase largo funcionó bien porque hacía más fácil leer el recorrido del balón. El plano cerrado con seguimiento también ayudó a mostrar al número 7 azul cerca de la línea de fondo y bajo presión del defensor.

Aun así, el resultado no fue perfecto. Algunos números de los jugadores no se mantuvieron estables y ciertas acciones las ejecutaron los jugadores equivocados. La doble marca de los números 1 y 2 del equipo rojo tampoco quedó demasiado clara.

Con todo, para un prompt con varios jugadores, múltiples pases y diferentes tipos de plano, el resultado fue sólido. Demuestra que el modelo entiende una secuencia multishot básica, aunque se pierdan algunos detalles.

Secuencia de montaje en paralelo

Después probamos una secuencia de montaje en paralelo. Este tipo de storyboard es útil para crear un contraste narrativo o emocional fuerte. Un ejemplo clásico es la secuencia del bautizo en The Godfather, donde la participación de Michael en la ceremonia se intercala con los asesinatos de los jefes de las Cinco Familias.

Para esta prueba usamos una situación más cómica: un ratón actúa en el escenario para distraer al público mientras sus compañeros aprovechan para robarles. El montaje en paralelo es una forma natural de mostrar ese contraste.

Resultado

En general, el resultado fue bastante bueno. El modelo sí utilizó una estructura de montaje en paralelo y logró crear sensación de contraste. La secuencia probablemente habría funcionado aún mejor con más reacciones del público.

Sin embargo, cuando la presión de información aumenta, también aumentan los errores y los detalles omitidos, así que los creadores siguen necesitando hacer concesiones con cuidado. La tasa de uso estimada para este video ronda el 85%.

Secuencia en plano secuencia

A continuación probamos una secuencia en plano secuencia. Para esta prueba creamos una escena de parkour ambientada en Marruecos, siguiendo a un joven a través de azoteas, calles, callejones, casas y patios.

Es una prueba útil porque un video de un solo plano no puede esconder errores detrás de los cortes. El modelo tiene que mantener conectados al personaje, el movimiento de cámara y las localizaciones de principio a fin. También necesita transmitir velocidad y emoción sin perder la claridad del entorno marroquí.

Resultado

En general, el video mantuvo bastante bien el estilo de plano secuencia de principio a fin. También mostró con acierto el entorno urbano marroquí, con azoteas, calles estrechas, callejones y edificios tradicionales que dejaban clara la localización.

El principal problema fue la carrera. En algunos momentos, el trazador no se movía como una persona real. Sus pasos no siempre parecían apoyar de verdad sobre el suelo y los aterrizajes carecían del peso que se espera de una carrera o un salto reales. A veces daba la impresión de que sus pies flotaban un poco por encima del suelo, más como un personaje de videojuego que como un corredor real.

Aun así, para una escena rápida de un solo plano con tantos cambios de espacio, el resultado fue fuerte. La acción se mantuvo conectada y la atmósfera de las calles marroquíes llegó con claridad.

Resumen de utilidad

Si miramos la tasa de utilidad de los cuatro videos juntos, el primero fue casi un 100% utilizable, con errores solo en los números de la camiseta. El segundo estuvo cerca del 90%, con algunos errores de cámara además de los números. El tercero rondó el 70%. El cuarto se acercó al 95%. Poco después del lanzamiento de Seedance 2.0 apareció la afirmación de que su tasa de utilidad podía llegar al 90%. A la vista de estas pruebas, esa cifra no parece demasiado exagerada.

Prueba de seguimiento de instrucciones

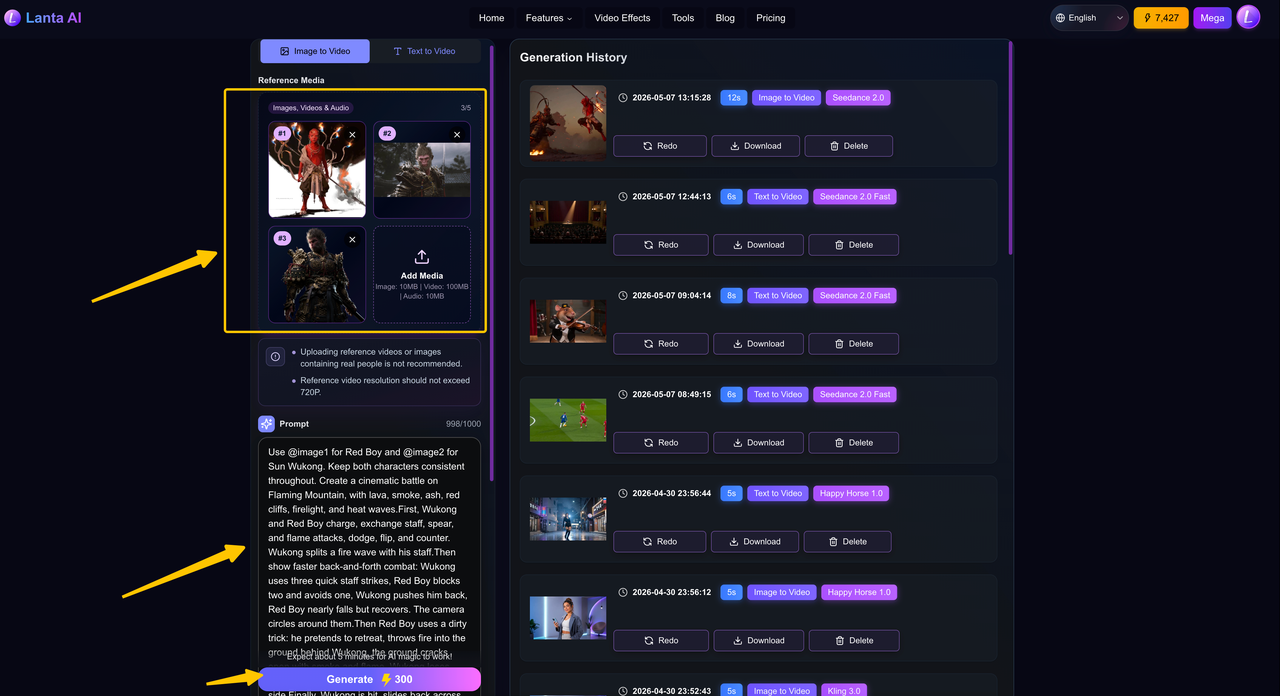

La siguiente fue la prueba de seguimiento de instrucciones. Requirió escribir guiones muy detallados con Gemini y preparar de antemano referencias de imagen completas.

Como la escena incluía a Sun Wukong y Red Boy del juego Black Myth y solo trabajaba con una única IP, las exigencias de referencia visual y fusión no eran especialmente altas. El foco principal era el seguimiento de instrucciones.

La trama general era bastante convencional: Sun Wukong y Red Boy luchan en Flaming Mountain. El combate va y viene hasta que Red Boy recurre a un truco sucio para derribar a Sun Wukong.

Resultado

El video completo se veía impresionante. La carga de Red Boy, el bastón dorado de Sun Wukong, el aliento de fuego y el bloqueo del ataque con poder mágico se sentían cercanos a una producción animada oficial.

La mayor sorpresa fue la calidad de la acción y de lo visual. El modelo manejó muy bien las explosiones de energía, los efectos de fuego, los ataques a gran escala y los choques de poder. También captó con bastante precisión el estilo visual de la IP. Con prompts todavía más detallados, el resultado probablemente podría llevarse aún más lejos.

Pero esta escena también exigía mucho a nivel narrativo. El modelo era bueno con el gran espectáculo y los efectos visuales, pero le costaba más manejar pequeños matices emocionales. Por ejemplo, era difícil mostrar con claridad un cambio emocional de arrogancia a miedo. Ese terminó siendo uno de los límites principales del video final.

Prueba de referencias multimodales

La siguiente fue la prueba de referencias multimodales. Primero evaluamos la capacidad de Seedance 2.0 para apoyarse en audio.

El primer archivo de audio usado en la prueba fue el estribillo de Blue Bird. Le dimos al modelo esa sección junto con una imagen de un concierto con una audiencia masiva.

Lo más sorprendente fue que el modelo pudo crear o reconstruir contenido por su cuenta. Por ejemplo, los tres segundos previos al inicio del canto no se los habíamos dado. El modelo extendió esa parte solo. La melodía coincidía con la canción original, pero presentada con la atmósfera de una actuación en vivo.

Aún más llamativo fue que los movimientos labiales de la cantante coincidían perfectamente con la canción. La única pena es que el archivo que le dimos ya duraba casi 15 segundos. Después de añadir tres segundos más, ya no quedaba tiempo suficiente y una línea del final se perdió.

Después probamos referencias de video. Probablemente esta sea la parte que mejor muestra qué diferencia a Seedance 2.0. Generar video a partir de efectos o música no es del todo nuevo. Por ejemplo, el modelo MoCha de Meta ya había explorado ideas similares.

En esta prueba adoptamos un enfoque más creativo: sustituimos a Levi por Zenitsu Agatsuma de Demon Slayer y lo hicimos luchar contra el Titán Bestia. Como los dos personajes tienen estilos de combate muy distintos, no intentamos recrear cada movimiento complejo fotograma a fotograma. En su lugar, nos concentramos en un gesto icónico: Thunder Breathing, First Form: Thunderclap and Flash.

El resultado fue sorprendentemente bueno. El modelo captó la sensación de un personaje pequeño y veloz luchando en el aire contra un enemigo gigante, al tiempo que mostraba fuertes efectos de viento, relámpagos dorados, una carrera de alta velocidad e impactos de tormenta muy potentes. Incluso usó primeros planos del rostro del Titán Bestia para mostrar sorpresa y miedo, mientras mantenía la lógica original de la acción con Zenitsu avanzando por el brazo del Titán hacia su cabeza.

En nuestra prueba con referencias de video vimos que este tipo de referencia guía mejor al modelo que las imágenes fijas. No se limita a copiar elementos visuales: puede seguir el ritmo, el movimiento de cámara y el estilo de acción del video de referencia. Incluso puede recrear la sensación de distintos estilos de anime o de cine.

Aun así, este nivel de control sigue siendo difícil de conseguir y los resultados no siempre son consistentes. Cuando la escena se vuelve demasiado compleja, el modelo empieza a topar con sus límites. Si el prompt contiene demasiada información o demasiados pequeños pasos lógicos, le cuesta seguirlo todo. En esos casos suele refugiarse en montajes rápidos o fragmentos con estética de tráiler para simplificar la tarea.

Incluso con eso, las mezclas creativas todavía pueden producir resultados sorprendentes. Los detalles no siempre son exactos, pero la capacidad del modelo para crear videos expresivos y visualmente impactantes ya se siente lo bastante fuerte para usos reales de producción.

Limitaciones de Seedance 2.0

Aunque Seedance 2.0 ha dado un gran paso adelante en controlabilidad, todavía está muy lejos de ser un simulador perfecto del mundo. Frente a competidores como Sora 2 y Google Veo 3.1, no lidera en todos los frentes.

Los efectos físicos complejos todavía carecen de realismo

Los modelos actuales de video con IA todavía parecen modelar el mundo físico más por coincidencia de patrones que por razonamiento desde primeros principios. Eso significa que siguen mostrando debilidades cuando se enfrentan a interacciones físicas complejas o poco comunes.

Por ejemplo, las salpicaduras de agua sencillas generadas por Seedance 2.0 pueden verse bastante bien. Pero cuando hay flujos de líquido más complejos, telas que se pliegan y estiran en movimientos rápidos o movimientos sutiles del cabello, el resultado todavía puede sentirse rígido y menos realista.

Al manejar colisiones, objetos apilados o manipulación fina de objetos, Seedance 2.0 todavía presenta rarezas típicas de la IA, como clipping, flotación o aceleraciones poco naturales. Su comprensión de las relaciones espaciales, del contacto entre objetos y de cómo se transmite la fuerza entre ellos todavía necesita mejorar.

En el video largo empiezan a derivar los detalles

Aunque Seedance 2.0 mantiene una buena coherencia dentro de una sola generación de unos diez segundos, los problemas empiezan a aparecer cuando el video se alarga. A día de hoy, todos los modelos de video siguen sufriendo el reto de la pérdida de memoria.

En un video narrativo de varios minutos, el modelo necesita mantener consistentes la motivación de los personajes, los detalles de la escena y el estado de los objetos a lo largo del tiempo. Eso exige una memoria a largo plazo fuerte, y sigue siendo difícil para los modelos actuales. Por ahora, este tipo de video sigue necesitando edición manual y generación por segmentos para conservar la coherencia.

En algunos videos generados por usuarios, incluso Seedance 2.0 puede mostrar ligeras derivas de textura o parpadeos en la segunda mitad del clip, especialmente en patrones finos, texto o detalles del fondo.

El contenido realista puro a partir de texto puede quedar por detrás de la competencia

Frente a Sora 2 y Veo 3.1, Seedance 2.0 muestra ventajas claras en varias áreas, pero también tiene puntos débiles.

Sora y Veo parecen centrarse más en simular un mundo real, mientras que Seedance 2.0 se centra más en construir un set controlable. Para contenidos cortos que requieren salida rápida y un realismo muy alto, la sincronización nativa de audio y video de Veo 3.1 puede ser una mejor elección. Pero para creadores profesionales que necesitan un control fino sobre la actuación de los personajes, el lenguaje de cámara y el estilo visual, el flujo de trabajo más cercano al de un director que ofrece Seedance 2.0 puede resultar más atractivo.

Cuando genera contenido puramente realista solo a partir de texto y sin referencias, Seedance 2.0 a veces puede quedar por detrás de sus competidores en realismo humano y en detalles sutiles de iluminación. Eso podría deberse a decisiones distintas en el diseño del modelo y en el enfoque de los datos de entrenamiento.

Conclusión

Seedance 2.0 se ha vuelto bastante más fiable. Incluso cuando una generación falla, rara vez queda totalmente inutilizable. Normalmente hay partes que todavía se pueden conservar, editar o reutilizar. Eso importa porque desplaza la pregunta de «¿se puede usar el video con IA?» a «¿cómo podemos usarlo mejor?».

Su base más sólida es el storyboard. Cuando el prompt es claro y la densidad de información es razonable, el modelo puede seguir bien estructuras multishot, lógica de acción y direcciones de cámara con un nivel fuerte de completitud. Aun así, su narración sigue sintiéndose más como cumplir correctamente la tarea que como expresarla con una visión de dirección realmente marcada.

Seedance 2.0 también impresiona en acción, VFX y generación basada en referencias, sobre todo cuando se usan referencias visuales o de video para fusionar estilos. Pero cuando una escena exige control emocional muy fino, mucha densidad narrativa o intención precisa fotograma a fotograma, el modelo todavía tiende a volver a opciones más seguras.

Si tú también quieres probar la generación de video con IA, visita la página de Seedance 2.0 en Lanta AI y empieza a crear hoy mismo.