Text to video artificial intelligence transforme des prompts ecrits en courts clips video. Au lieu de filmer une scene, vous decrivez ce que vous voulez voir, et le modele genere le mouvement, le cadrage, le style et les details de scene a partir de cette instruction.

C'est maintenant un workflow d'IA pratique plutot qu'une simple demo. OpenAI presente Sora comme un modele video capable de creer des clips detailles avec audio a partir du langage naturel ou d'images, Google positionne Veo comme un modele de generation video avec davantage de controle creatif, et Runway documente des workflows orientes prompts pour la scene, le mouvement et la camera.

Reponse rapide

Text to video artificial intelligence fonctionne en interpretant votre prompt ecrit puis en synthetisant un clip correspondant. En pratique, ces systemes mappent le sujet, l'action, la scene, le mouvement de camera, le style et l'ambiance, puis generent une sequence d'images qui se rapproche le plus possible de la demande.

Points a retenir

- Text-to-video AI cree des clips video a partir de prompts ecrits.

- La qualite du prompt compte parce que le modele a besoin d'une direction claire sur le sujet, le mouvement, le style et le comportement de la camera.

- Les bons workflows sont iteratifs : generer, revoir, affiner et regenerer.

- Text to video part de mots, tandis que image to video part d'une image existante.

Qu'est-ce que text to video artificial intelligence ?

Text to video artificial intelligence est une forme d'IA generative qui cree de la video a partir d'instructions textuelles. Vous ecrivez un prompt comme "un plan de drone cinematographique au-dessus de montagnes enneigees au lever du soleil", et le modele genere un clip concu pour correspondre a cette description.

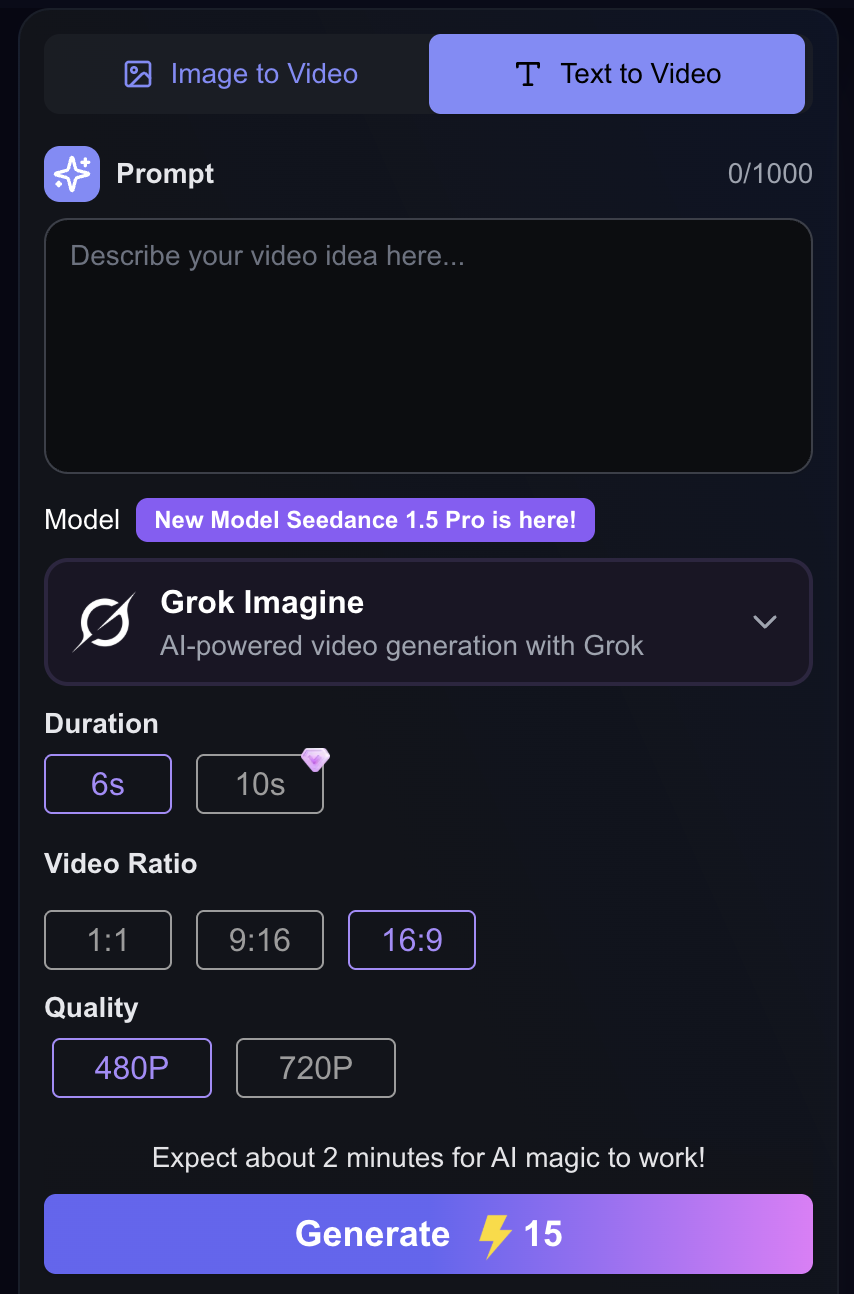

Ce workflow coexiste avec des modes proches comme image to video et video to video. Cela compte parce que certains createurs partent d'une idee formulee en mots, tandis que d'autres ont deja une image de reference qu'ils veulent animer. Si l'intention de recherche reste exploratoire, text to video est souvent le premier point d'entree.

Du prompt au rendu

Un modele mental simple

Prompt

Decrivez le sujet, l'action, le style et la direction de camera.

Modele IA

Le modele interprete le mouvement, le cadrage et la continuite de la scene.

Sortie video

Vous examinez le clip, affinez le prompt et regenerez.

Comment text to video AI fonctionne-t-il vraiment ?

A haut niveau, le modele commence par interpreter votre prompt. Il essaie de comprendre le sujet, l'environnement, l'action, le style visuel, la direction de camera et l'ambiance. Ensuite, il genere une sequence d'images qui suit ces instructions et tente de garder la scene coherente dans le temps.

C'est pour cela que la qualite du prompt compte. Si le prompt est vague, le modele doit deviner. Si le prompt definit clairement le sujet, le decor, l'action, le style visuel et le mouvement de camera, le resultat se rapproche generalement beaucoup plus de ce que vous vouliez vraiment.

Sujet

Ce qui ou qui apparait dans le clip.

Environnement

L'endroit ou se deroule la scene et le contexte visuel qui l'entoure.

Action

Ce qui bouge, change ou se produit pendant le plan.

Style

Si le resultat doit sembler cinematographique, anime, brillant, minimal ou realiste.

Camera

Si le plan doit faire un panoramique, un travelling, une derive, rester fixe ou donner une impression de camera a la main.

Continuite

La capacite de la scene a rester coherente d'une image a l'autre.

Que se passe-t-il apres avoir entre un prompt ?

La plupart des workflows text-to-video suivent la meme boucle : ecrire un prompt, generer un premier clip, revoir le resultat, affiner le prompt, puis generer a nouveau ou editer davantage. Cette iteration n'est pas une rustine. C'est le workflow normal.

Ecrire un prompt

Decrivez aussi clairement que possible le sujet, le decor, le mouvement, le style et le comportement de la camera.

Generer un premier clip

Le modele transforme ce prompt en une courte sequence d'images avec mouvement et structure de scene.

Revoir le resultat

Examinez la qualite du mouvement, le cadrage, la coherence de la scene et si l'ambiance correspond a votre intention.

Affiner le prompt

Precisez l'action, simplifiez la scene ou ajoutez des indications de camera et de style la ou le resultat s'eloigne.

Regenerer ou editer

Les workflows efficaces s'ameliorent en quelques iterations plutot qu'avec un seul prompt parfaitement formule.

Essayer AI Text to Video

Transformez des prompts ecrits en courtes videos, comparez plusieurs variantes de prompts et passez de la theorie a de vrais resultats sur la page outil de Lanta AI.

A quoi peut servir text to video artificial intelligence ?

Pour les petites equipes, l'avantage principal est souvent la vitesse. Au lieu de planifier tout un tournage, vous pouvez tester des directions visuelles directement a partir du texte. Cela rend text-to-video AI particulierement utile pour les concept videos, les pubs, les clips sociaux, les teasers produit, les explainers et les experiments creatifs.

Cinematographique

Prompts centres sur le paysage, le mouvement et la lumiere.

Anime

Mouvement de personnage stylise avec une grammaire visuelle plus simple.

Oriente produit

Presentation type studio avec une composition adaptee aux boucles.

Pourquoi les prompts sont-ils si importants ?

Un modele text-to-video ne peut travailler qu'avec les instructions que vous lui donnez. C'est pourquoi un prompt solide inclut generalement le sujet, le decor, l'action, le style visuel, le mouvement de camera et l'ambiance. Plus l'instruction est specifique, moins le modele doit inventer a votre place.

Prompt faible

a dog in a park

Le modele doit deviner la race, la lumiere, le mouvement, l'angle de camera, le moment de la journee et le ton emotionnel.

Prompt plus solide

a golden retriever running through a sunlit park at golden hour, cinematic slow motion, shallow depth of field, soft warm lighting, handheld camera feel

Cette version donne au modele une direction explicite sur le sujet, le mouvement, le style, le cadrage et la lumiere.

Boite d'exemples de prompts

Cinematographique

"Wide aerial drone shot over misty mountain valleys at sunrise, soft fog drifting, slow forward camera movement, volumetric light rays, ultra-realistic, calm atmosphere."

Pourquoi cela fonctionne : Le decor, la lumiere, le mouvement et la direction de camera sont clairs, ce qui aide le modele a construire une scene plus coherente.

Anime

"Cute 2D mascot character waving to the camera, bright flat colors, smooth loop animation, simple clean background, friendly vibe."

Pourquoi cela fonctionne : Un style visuel plus etroit et un objectif de mouvement simple reduisent la derive visuelle et gardent le rendu lisible sur mobile.

Pub produit

"Close-up of a black wireless earbud rotating on a glossy table, neon reflections, macro depth of field, seamless loop, studio lighting."

Pourquoi cela fonctionne : Un sujet unique, un eclairage controle et une instruction de boucle produisent generalement des clips promotionnels plus solides.

Text to video vs image to video

Text to video commence avec des mots. Image to video commence avec une image et l'anime. Les deux sont utiles, mais ils repondent a des usages differents et a des intentions de recherche differentes.

| Mode | Point de depart | Ideal pour | Pourquoi les utilisateurs le choisissent |

|---|---|---|---|

| Text to video | Un prompt ecrit | L'exploration d'idees, le concepting rapide et les workflows sans asset preexistant | Vous voulez passer du concept au mouvement sans preparer d'images au prealable. |

| Image to video | Une image importee ou une image de reference | Le controle visuel, la coherence d'un personnage et l'animation d'un asset existant | Vous savez deja a quoi la scene doit ressembler et vous voulez l'animer a partir de cette base. |

Si vous savez deja a quoi la scene doit ressembler, image to video donne generalement plus de controle visuel. Si vous voulez explorer des idees depuis zero, text to video est souvent un meilleur point de depart.

Quelles sont les principales limites de text to video AI ?

Meme les modeles solides ont encore des limites. Les interactions physiques complexes, la coherence parfaite, le controle exact d'une scene et la continuite narrative longue restent difficiles. En pratique, il faut s'attendre a iterer plutot qu'a traiter le premier rendu comme une sortie finale.

Les interactions physiques complexes peuvent encore sembler peu fiables.

La continuite narrative longue est plus difficile que les clips courts a scene unique.

Le controle precis de la scene et la coherence d'un personnage demandent souvent plusieurs iterations.

Les prompts trop charges peuvent introduire de l'ambiguite au lieu d'apporter plus de controle.

Comment obtenir de meilleurs resultats avec text to video AI

La facon la plus simple d'ameliorer la sortie est de penser comme un realisateur, pas seulement comme quelqu'un qui aligne des mots-cles. Decrivez ce que le spectateur doit voir, ce qui doit bouger, comment la camera doit se comporter et quelle ambiance la scene doit produire.

Etat d'esprit de realisateur

- Qu'est-ce que le spectateur doit remarquer en premier ?

- Quel est le mouvement principal dans la scene ?

- La camera doit-elle rester fixe ou bouger ?

- Quelle tonalite emotionnelle le clip doit-il produire ?

Workflow pratique pour debuter

Decrivez d'abord ce que le spectateur doit voir, pas seulement le sujet.

Precisez ce qui doit bouger et ce qui doit rester stable.

Ajoutez un style visuel clair au lieu d'empiler des adjectifs vagues.

Utilisez le comportement de la camera pour guider le rythme du plan.

Traitez la premiere version comme un brouillon utile, pas comme le resultat final.

Essayez text to video par vous-meme

Si vous voulez passer de la theorie a la pratique, le plus simple est de tester un vrai outil. Vous pouvez essayer l'outil AI text to video de Lanta AI pour transformer des prompts ecrits en courtes videos et voir comment la structure du prompt modifie le resultat.

Pourquoi cette page convertit bien

Les utilisateurs qui recherchent text to video artificial intelligence veulent d'abord comprendre le concept. Une fois cette comprehension acquise, ils sont proches d'essayer un outil reel. C'est pour cela que ce sujet relie naturellement l'intention informationnelle a la page produit.

Conclusion

Text to video artificial intelligence fonctionne en traduisant des prompts ecrits en clips video generes, grace a des modeles capables d'interpreter le sujet, le mouvement, la structure de scene, le style et la continuite.

Pour les utilisateurs, l'idee principale est simple : text-to-video AI n'est plus seulement une experience. C'est en train de devenir une facon pratique de prototyper des idees, de creer du contenu social, d'explorer des scenes et d'accelerer la production creative.

Le meilleur moyen de comprendre text-to-video AI reste de le tester.

Si vous voulez aller plus loin, essayez l'outil AI text to video de Lanta AI et comparez quelques variantes de prompt sur un meme concept.

Questions frequentes

Essayer AI Text to Video

Transformez des prompts ecrits en courtes videos, comparez plusieurs variantes de prompts et passez de la theorie a de vrais resultats sur la page outil de Lanta AI.