KI-Videogenerierung ist leistungsstark, aber fehlerhafte Generationen gehören immer noch zu den größten Frustfaktoren. Ein Produkt kann plötzlich seine Form ändern, ein Referenzbild wird ignoriert, oder ein detaillierter Prompt führt zu einem Video, das nur die grobe Idee trifft, aber den eigentlichen Shot-Plan verfehlt.

Genau deshalb wollte ich HappyHorse 1.0 aus einer praktischeren Perspektive testen: Kann es die Art von Fehlern reduzieren, die normalerweise Zeit, Credits und kreative Energie verschwenden?

In diesem Praxistest habe ich HappyHorse 1.0 auf drei Arten eingesetzt: zuerst mit einem einzelnen Produktbild der DJI Pocket 3, um die Produktkonsistenz zu prüfen, dann mit fünf Referenzbildern, um das Verständnis mehrerer Produktperspektiven zu testen, und schließlich mit einem reinen Text-Prompt für ein Café, um zu sehen, wie gut das Modell mehrteilige Kameraanweisungen befolgt.

Test 1: Image-to-Video: Produktkonsistenz

Um zu testen, ob HappyHorse1.0 aus einem einzelnen Produktbild der DJI Pocket 3 ein überzeugendes 5-Sekunden-Promo-Video für die Produktpräsentation machen kann, habe ich ein kurzes Experiment durchgeführt.

Der Stabilität zuliebe habe ich das Produktbild nicht einfach direkt in das Videomodell geworfen und auf Glück gehofft. Stattdessen habe ich zuerst mit GPT Image 2 ein sauber ausgearbeitetes Produkt-Ad-Bild erzeugt, dieses als ersten Frame verwendet und es anschließend in HappyHorse1.0 eingespeist, um einen 5-Sekunden-Clip zu generieren.

Ich habe im Browser die Seite AI Video Generator von Lanta AI geöffnet und im linken Panel den Modus Image to Video ausgewählt. Danach habe ich das mit GPT Image 2 erzeugte Referenzbild der DJI Pocket 3 hochgeladen. In der Oberfläche sieht man, dass HappyHorse1.0 bis zu 9 Referenzbilder unterstützt, in diesem Test habe ich aber nur eines verwendet.

Anschließend habe ich den folgenden Prompt in das Eingabefeld eingefügt. Wichtig ist dabei, dass der Prompt unter 1000 Zeichen bleiben muss.

Halte das Produktdesign so nah wie möglich am echten DJI Pocket 3. Gestalte weder Objektiv, Gimbal, Bildschirm, Tasten, Gehäuseform, Logo-Position noch Proportionen um. Bewahre die ursprüngliche Produktstruktur während des gesamten Videos.

Erstelle einen 5-sekündigen vertikalen Produkt-Teaser für die DJI Pocket 3. Halte das Produkt jederzeit zentriert, scharf und sehr präzise. Gestalte das Produkt nicht neu und verändere weder Objektiv, Gimbal, Bildschirm, Tasten noch die Proportionen des Gehäuses.

Kamerabewegung: Starte mit einer mittleren, etwas weiteren Produktaufnahme und fahre dann langsam auf das Objektiv zu.

Licht: Verwende dramatisches Studiolicht mit kühlem blauem Rim Light und einem weichen weißen Highlight, das über die untere Hälfte des Produktkörpers streicht.

Hintergrund: dunkler, minimalistischer, futuristischer Hintergrund mit dezenten blauen Lichtstreifen und glänzenden Bodenreflexionen. Stil: hochwertiger Tech-Spot, cinematischer Produkt-Showcase, cleaner Ecommerce-Look, weiche Bewegung.Für die Videoeinstellungen habe ich gewählt:

- Modell: HappyHorse1.0

- Dauer: 5 s

- Videoformat: 9:16

- Qualität: 1080P

Diese Generation kostet ungefähr 175 Credits. Nachdem alles eingestellt war, habe ich auf Generate geklickt. Tatsächlich musste ich etwa 3–4 Minuten warten und bekam dann ein solches DJI-Pocket-3-Promo-Video.

Im finalen Ergebnis bleibt die DJI Pocket 3 sauber in der Bildmitte. Der schwarze Hintergrund, die blauen Lichtstreifen, die kühlen Highlights und der reflektierende Boden unterstreichen genau das technologische Gefühl, das man sich bei einem Imaging-Produkt wie der DJI Pocket 3 wünscht.

Über das gesamte Video hinweg bleiben Form und Proportionen der Kamera stabil. Objektiv, Gimbal und Bildschirm sitzen an den richtigen Stellen, und auch das Logo bleibt klar erkennbar. Es gibt keine offensichtliche Produktverzerrung und kein seltsames KI-Redesign.

Gleichzeitig ist die Kamerabewegung sehr flüssig. Das deutliche Push-in lenkt den Blick gezielt auf die wichtigsten Teile des Produkts.

Test 2: Videoerzeugung mit mehreren Referenzbildern

Als Nächstes wollte ich den Test einen Schritt weiterführen und sehen, wie gut HappyHorse 1.0 mit Videoerzeugung auf Basis mehrerer Referenzbilder umgeht. Diesmal habe ich fünf DJI-Pocket-3-Bilder aus unterschiedlichen Perspektiven hochgeladen, darunter eine frontale Ansicht, mehrere schräge Seitenansichten, eine Handheld-Ansicht und eine Rückansicht. Das Ziel war zu prüfen, ob das Modell dasselbe Produkt aus mehreren Blickwinkeln versteht und diese Perspektiven in einem einzigen generierten Video zusammenführen kann. Gleichzeitig wollte ich sehen, ob das Video Vorderseite, Seite und Rückseite des Produkts natürlich zeigen kann, während sich die Kamera bewegt.

Danach habe ich denselben Workflow wie zuvor wiederholt: Prompt eingeben, Parameter setzen, Video generieren. Das ist das Ergebnis.

Im finalen Video bewegt sich der Shot langsam von der Frontansicht zur Seite, zeigt dann die Rückseite und sogar eine handheld-artige Perspektive der DJI Pocket 3. Dadurch wirkt das Ganze wie ein vollständiger Produkt-Showcase. Man muss das Produkt nicht mehr selbst aus mehreren Winkeln filmen und auch nicht manuell schneiden.

Auf Basis der Referenzbilder kann der KI-Videogenerator automatisch ein kurzes Video mit fließenden Übergängen und wechselnden Perspektiven erzeugen. Das ist besonders nützlich für Ecommerce-Anzeigen, Produkt-Teaser und kurze Social-Media-Videos.

Test 3: Text-Prompt-Genauigkeit und Multi-Shot-Bewegung

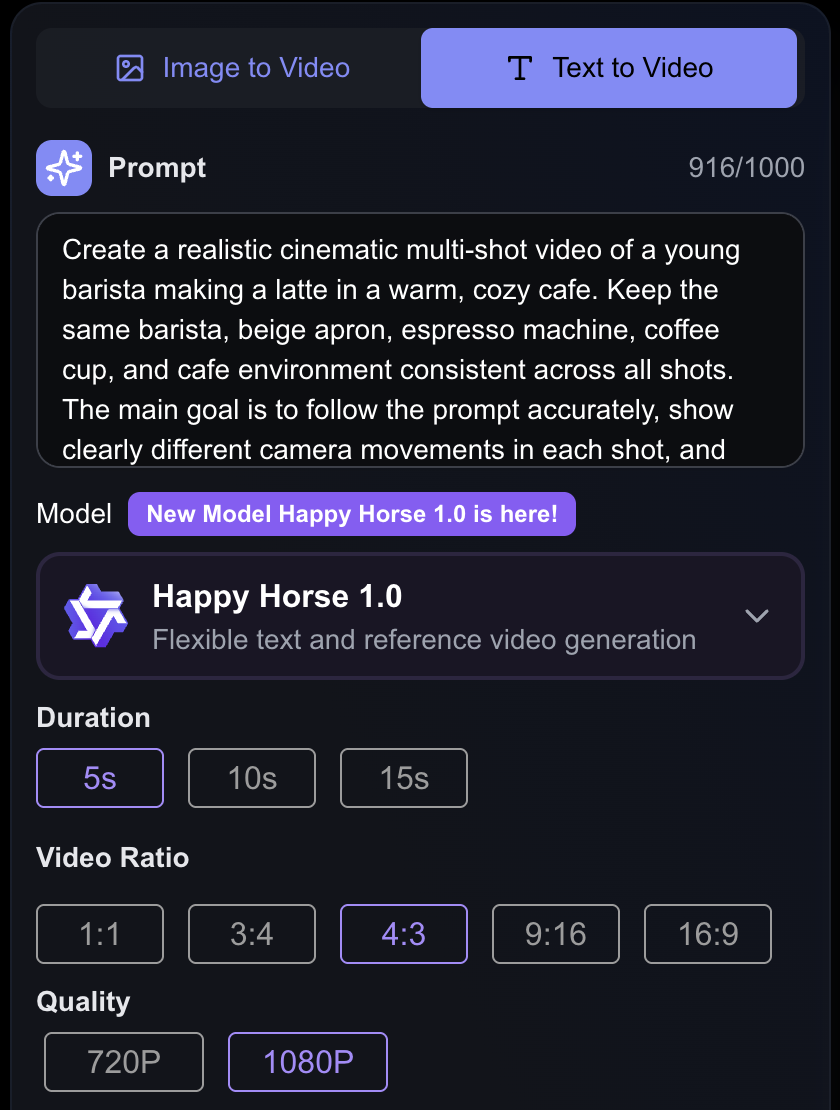

Für das letzte Experiment habe ich ausschließlich text-to-video verwendet, um HappyHorse 1.0 im Hinblick auf Text-Prompt-Genauigkeit und Multi-Shot-Bewegung zu testen. In das Eingabefeld habe ich folgenden Prompt geschrieben:

Erstelle ein realistisches, cinematisches Multi-Shot-Video einer jungen Barista, die in einem warmen, gemütlichen Café einen Latte zubereitet. Halte in allen Shots dieselbe Barista, dieselbe beige Schürze, die Espressomaschine, die Kaffeetasse und die Café-Umgebung konsistent. Das Hauptziel ist, dem Prompt präzise zu folgen, klar unterschiedliche Kamerabewegungen in jedem Shot zu zeigen und die Übergänge zwischen den Shots weich und natürlich zu halten.

Shot 1: ein weiter Establishing Shot des Cafés, mit der jungen Barista an der Espressomaschine. Verwende einen langsamen Dolly-in.

Shot 2: ein mittlerer Seitenwinkel mit leichtem Tracking, in dem die Barista den Siebträger einsetzt und die Espresso-Extraktion startet.

Shot 3: ein Close-up, in dem Espresso in eine Tasse läuft, gefolgt vom Eingießen der Milch für den Beginn des Latte Art.

Shot 4: eine Top-down-Aufnahme oder ein Hero Shot des fertigen Latte auf einem Holztisch, mit gut sichtbarem Latte Art und einer subtilen Orbit- oder eleganten Overhead-Bewegung.

Für die Videoeinstellungen habe ich gewählt:

- Modell: HappyHorse1.0

- Dauer: 5 s

- Videoformat: 4:3

- Qualität: 1080P

Text-to-video braucht spürbar länger als image-to-video. Ich habe rund 5 Minuten gewartet und erhielt ein Video wie dieses: eine Barista, die in einem Café Kaffee zubereitet.

Ich habe HappyHorse 1.0 keine Referenzbilder gegeben, daher wurden sowohl die Figur als auch das Setting vollständig vom Modell selbst erdacht. In Bezug auf die Prompt-Genauigkeit war das Ergebnis dennoch ziemlich solide. Die warme Café-Atmosphäre, die junge Barista, die Schürze, die Kaffeemaschine, die Tasse und der gesamte Latte-Zubereitungsprozess tauchen im Ergebnis auf, und insgesamt bleibt das Video thematisch stabil.

Besonders gut fand ich, wie sauber HappyHorse 1.0 die Shot-Struktur des Prompts verstanden hat. Im finalen Video erkennt man deutlich die Staffelung aus weitem Establishing Shot, mittlerem Seitenbild, Close-up und Top-down- bzw. Hero-Shot. Das Modell hat es geschafft, innerhalb von nur 5 Sekunden zwischen mehreren Shots zu wechseln.

Für mich zeigt dieser Test eine der größten Stärken von HappyHorse 1.0: Es kann relativ komplexe Shot-Planung verstehen, flüssige Übergänge erzeugen und versuchen, diese Shots zu einem zusammenhängenden Video zu ordnen.

Womit HappyHorse 1.0 noch zu kämpfen hat

Trotzdem würde ich nach dem Test nicht sagen, dass HappyHorse 1.0 jedes Mal ein sofort veröffentlichungsreifes Video perfekt erzeugen kann. Die Visuals und die Fähigkeit zur Shot-Planung sind wirklich stark, aber sobald echte Produkte, Nahaufnahmen von Menschen oder längere kontinuierliche Bewegung ins Spiel kommen, sollte man das Ergebnis weiterhin sorgfältig prüfen.

In Produktvideos kann das Modell zum Beispiel noch kleine Produktdetails umgestalten, sodass das Ergebnis nicht vollständig mit dem realen Produkt übereinstimmt. Ähnliches gilt für Menschen. Kurze Clips sind meist stabiler, aber wenn die Bewegung komplexer wird oder ein Shot länger dauert, können kleine Veränderungen im Gesicht, an den Händen, an der Kleidung oder in anderen Details auftreten.

Wofür eignet sich HappyHorse 1.0 am besten?

Short-Form-Creator

Wenn du TikToks, Reels, Shorts oder Social Ads produzierst, lohnt sich ein Test mit HappyHorse 1.0 auf jeden Fall.

Kurzform-Video braucht schnelle Hooks, starke Visuals, vertikale Formate und viele Varianten. Genau hier spielt HappyHorse 1.0 seine Stärken aus.

Es ist nicht dafür gebaut, eine komplette Geschichte von Anfang bis Ende zu erzählen. Es ist stärker darin, einen visuellen Moment zu liefern: einen Produkt-Close-up, eine cinematische Bewegung, einen Teaser-Shot oder einen Clip, der den Scroll stoppt.

Ecommerce-Marken

HappyHorse 1.0 passt auch gut zu Ecommerce-Teams.

Die meisten Marken haben bereits Produktfotos. Was oft fehlt, ist genug Videocontent für Ads, Landingpages, Produktseiten und Social Media.

Mit dem richtigen Referenzbild kann ein einziges Produktfoto zu einem vertikalen Teaser, einem Studio-Showcase, einem Lifestyle-Entwurf oder einem einfachen Motion-Asset für eine Produktseite werden.

Das macht es nützlich, wenn viele kreative Varianten gebraucht werden, man aber nicht jede Idee neu drehen möchte.

Ad-Creator

Für Werbekreative liegt der größte Wert in der Geschwindigkeit.

Bevor eine vollständige Kampagne gebaut wird, müssen Hooks, Szenen, Produkte, Stile und Formate getestet werden.

HappyHorse 1.0 kann genau in dieser frühen Phase helfen. Es zeigt schnell, ob eine visuelle Richtung Potenzial hat, bevor mehr Zeit in Schnitt, Produktion oder Kampagnen-Polish fließt.

Concept Artists und Storyboard-Creator

HappyHorse 1.0 kann auch bei der visuellen Planung helfen.

Wenn du einen statischen Frame, ein Produktkonzept oder ein Storyboard-Bild hast, kann es dieses Standbild in eine bewegte Vorschau verwandeln.

Das ist hilfreich, wenn du eine Szene pitchen, eine Kampagne planen oder prüfen willst, ob eine Idee in Bewegung funktioniert. Es ersetzt keinen vollständigen Produktionsprozess, kann aber die frühe Konzeptphase schneller und anschaulicher machen.

Fazit

Nach diesen drei Tests wirkt HappyHorse 1.0 wie eine starke Option, um einige der häufigsten Fehler bei der KI-Videogenerierung zu reduzieren.

Es ist kein magischer Button, der jedes Mal ein perfektes Video garantiert, aber es zeigt deutliches Potenzial für Creator, denen Produktgenauigkeit, Prompt-Kontrolle und flüssigere Shot-Übergänge wichtig sind.

Wenn du denselben Workflow ausprobieren willst, kannst du Lanta AI und seinen AI Video Generator direkt im Browser nutzen, um HappyHorse 1.0 mit image-to-video, Mehrbild-Referenzen und text-to-video zu testen.

Oder du springst direkt auf die HappyHorse-1.0-Modellseite, um seine Positionierung mit den übrigen Videomodellen von Lanta AI zu vergleichen.