Seedance 2.0 nous a impressionnés, mais pas pour la raison mise en avant dans la plupart des vidéos de démonstration.

Le point le plus intéressant n'était pas la seule qualité d'image. C'était le contrôle. Dans nos tests, Seedance 2.0 suivait mieux les indications de mise en scène, exploitait mieux les références visuelles et transformait un storyboard simple en une vidéo qui semblait davantage pensée que produite au hasard.

Sur ce point, Seedance 2.0 va plus loin que beaucoup de modèles vidéo pilotés uniquement par prompt. Mais il montre aussi des limites que les créateurs ne devraient pas ignorer. Un test a rendu son contrôle très impressionnant. Un autre a montré à quel point sa physique pouvait encore sembler artificielle.

La suite permet de voir ce que Seedance 2.0 réussit vraiment, où il se casse, et s'il est réellement utile à des créateurs vidéo.

Qu'est-ce que Seedance 2.0 ?

Seedance 2.0 est un modèle de génération vidéo par IA développé par ByteDance Seed. Il aide les créateurs à produire des vidéos IA plus contrôlables, plus réalistes et plus proches de besoins de production concrets.

Contrairement à un modèle text-to-video basique, il peut utiliser du texte, des images, des extraits vidéo et de l'audio comme références. Cela permet de guider plus finement le sujet, le mouvement de caméra, le style, le rythme et le son.

From Seedance 1.0 to Seedance 2.0

| Version | Ce qu'elle a ajouté | Comment cela a préparé la suite |

|---|---|---|

Seedance 1.0 | A lancé la série de modèles vidéo Seedance | A donné au modèle la capacité de base de créer de courts clips vidéo IA |

Seedance 1.5 | A amélioré la synchronisation audio-vidéo | A rendu l'association entre le son et l'image plus naturelle |

Seedance 1.5 Pro | A renforcé l'image-vers-vidéo et la génération audio | A posé une base plus solide pour un rendu vidéo de meilleure qualité et plus stable |

Seedance 2.0Actuelle | A réuni texte, images, vidéo et audio dans un seul workflow | A combiné références, édition, continuation vidéo, génération multi-plans et son natif en un outil de création vidéo IA plus complet |

Points forts de Seedance 2.0

Seedance 2.0 se distingue dans les scènes complexes, avec une meilleure stabilité du mouvement et une physique plus crédible. Il fonctionne particulièrement bien dans les interactions entre plusieurs personnages et dans les scénarios dynamiques complexes, en produisant davantage de clips réellement exploitables.

Par exemple, sur une routine complète de patinage artistique en couple, le modèle peut générer des sauts synchronisés, des rotations en l'air et des réceptions précises tout en gardant un mouvement physiquement crédible du début à la fin. Cela réduit un grand nombre d'erreurs physiques fréquemment observées dans les premières vidéos générées par IA.

- Contrôle multimodal par références. L'utilisateur peut fournir jusqu'à 9 images, 3 extraits vidéo et 3 extraits audio, en plus d'instructions en langage naturel. Le modèle s'en sert pour guider la composition, le mouvement, le langage de caméra, les effets visuels et le son. Il peut même utiliser des storyboards textuels comme référence créative.

- Davantage de contrôle sur la vidéo finale. Le modèle suit mieux les consignes, maintient une meilleure cohérence, prolonge les vidéos de façon plus stable et permet une édition ciblée. Les créateurs peuvent modifier précisément certains plans, personnages, actions ou éléments narratifs. Il ajoute aussi une planification de caméra pilotée par prompt, utile pour obtenir des plans avec des mouvements de caméra, des cadrages et une circulation visuelle plus lisibles.

- Génération audio stéréo sur deux canaux. Il prend en charge une sortie multipiste simultanée, incluant musique de fond, effets sonores d'ambiance et narration de personnages. Ces éléments audio peuvent être alignés avec le rythme visuel de la scène, ce qui donne un clip final plus poli, plus immersif et mieux calé.

- Sortie multi-plans de 15 secondes en haute qualité. En une seule génération, il peut produire jusqu'à 15 secondes de vidéo multi-plans avec du son, laissant davantage d'espace pour construire de vrais moments visuels plutôt qu'un simple échantillon de mouvement.

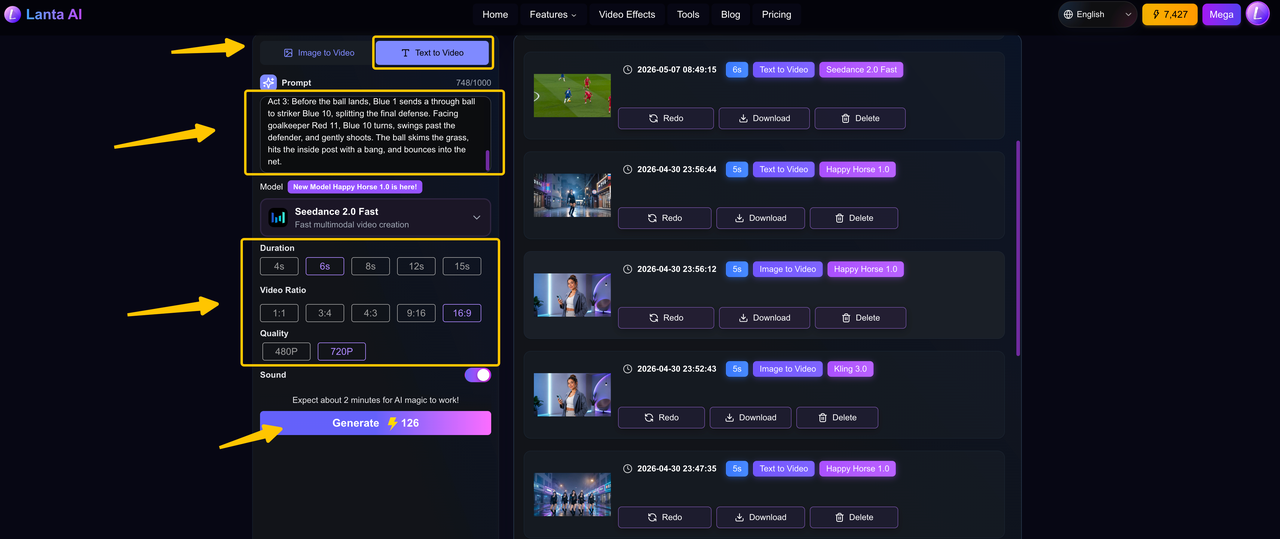

Test de storyboard et de mouvement de caméra

Nous avons commencé par un match de football, car c'est un bon test d'interaction entre plusieurs sujets. La scène demande à l'équipe bleue d'enchaîner cinq passes connectées, de percer la défense rouge, puis de marquer à la fin.

Même si cela paraît complexe, l'action peut être découpée en moments très clairs. Un plan peut se concentrer sur la première passe, le suivant peut suivre le receveur, et un autre montrer la réaction des défenseurs. La caméra doit suivre à la fois le ballon, les joueurs et le déplacement du point d'attention.

Dans notre premier test, nous n'avons pas donné au modèle de storyboard détaillé ni de consignes précises de caméra. Nous voulions voir comment il gérait la séquence par lui-même avant d'ajouter davantage de contrôle.

Premier essai sans indications de plans détaillées

Football match. Blue team faces strong red defenders, completes five precise passes, then scores.

Act 1: Blue 8 is pressed by Red 3 and calmly passes to Blue 6. Blue 6 instantly sends a diagonal long ball to sprinting right winger Blue 7.

Act 2: Near the baseline, Blue 7 stops, cuts back to avoid Red 9's sliding tackle, then pushes the ball toward the penalty arc. Red 1 and Red 2 close in. Blue 7 flicks the ball through Red 2's legs back to the advancing Blue 1.

Act 3: Before the ball lands, Blue 1 sends a through ball to striker Blue 10, splitting the final defense. Facing goalkeeper Red 11, Blue 10 turns, swings past the defender, and gently shoots. The ball skims the grass, hits the inside post with a bang, and bounces into the net.Résultat

Dans l'ensemble, le résultat vidéo était bon. Le numéro 10 de l'équipe bleue a bien terminé l'action, mais la séquence complète de passes n'a pas été reproduite intégralement. Au lieu de cinq passes clairement reliées, la vidéo n'en a montré qu'environ trois.

Au milieu de la séquence, plusieurs actions initialement attribuées au numéro 7 bleu et au numéro 1 bleu ont finalement été réalisées par le numéro 10. Le duel entre le numéro 7 bleu et les défenseurs rouges n'a pas non plus été montré clairement, ce qui rend cette partie moins détaillée que dans le prompt d'origine.

Il faut tout de même rappeler qu'il s'agissait de la première génération. Nous n'avons pas lancé plusieurs variantes en sélectionnant la meilleure. Atteindre ce niveau du premier coup reste déjà impressionnant, malgré les défauts.

Le storyboard et le mouvement de caméra n'étaient pas faux, mais ils manquaient aussi d'une vraie personnalité. C'était peut-être la façon pour le modèle de jouer la sécurité face à une tâche très dense en informations.

Ajout d'un storyboard plus précis et d'un langage de caméra plus clair

Nous avons ensuite testé ce qui se passait lorsqu'on ajoutait des consignes plus détaillées de storyboard et de mouvement de caméra.

In a football match, facing strong red-team players, the blue-team players complete five precise passes and finally score.

Act 1: Opening the Play - Passes 1-2

Shot 1 - Medium Shot: At the center of the frame, Blue No. 8 faces pressure from Red No. 3 and calmly passes the ball with the inside of his foot to Blue No. 6, who drops back to receive it.

Shot 2 - Wide Shot: After receiving the ball, Blue No. 6 does not hold onto it. He immediately sends a precise diagonal long pass. The ball draws a beautiful arc through the air and lands accurately at the feet of Blue No. 7, the right winger sprinting forward.

Act 2: Breaking Through the Defense - Passes 3-4

Shot 3 - Close-up / Tracking Shot: Near the baseline, Blue No. 7 suddenly stops and cuts the ball back, avoiding a sliding tackle from Red No. 9, then pushes the ball toward the top of the penalty arc.

Shot 4 - Low Angle: Two defenders, Red No. 1 and Red No. 2, move in to double-team him. Blue No. 7 lightly flicks the ball, sending it through Red No. 2's legs and back to Blue No. 1, who is rushing forward to complete the combination.Résultat

Cette fois, le modèle a presque parfaitement suivi le prompt et a bien montré sa capacité multi-plans. Le plan large sur la longue passe fonctionnait bien, car il rendait la trajectoire du ballon plus lisible. Le gros plan avec suivi aidait aussi à montrer le numéro 7 bleu près de la ligne de fond sous pression du défenseur.

Le résultat n'était toutefois pas parfait. Certains numéros de joueurs n'étaient pas cohérents, et certaines actions étaient exécutées par les mauvais joueurs. Le double marquage des numéros 1 et 2 rouges restait également peu clair.

Malgré cela, pour un prompt avec plusieurs joueurs, plusieurs passes et différents types de plans, le résultat était solide. Il montre que le modèle comprend une séquence multi-plans de base, même si certains détails se perdent.

Séquence de montage alterné

Nous avons ensuite testé une séquence en montage alterné. Ce type de storyboard est utile pour créer un contraste narratif ou émotionnel fort. L'exemple classique est la scène du baptême dans The Godfather, où la participation de Michael à la cérémonie est entrecoupée par les assassinats des chefs des Cinq Familles.

Pour ce test, nous avons pris une situation plus comique : une souris joue de la musique sur scène pour distraire le public pendant que ses complices profitent du moment pour les voler. Le montage alterné est un excellent moyen de rendre ce contraste lisible.

Résultat

Dans l'ensemble, le résultat était plutôt bon. Le modèle a bien utilisé une structure de montage alterné et a réussi à créer un effet de contraste. La séquence aurait probablement été encore meilleure avec davantage de réactions du public.

En revanche, sous forte pression informationnelle, les erreurs et les détails manquants augmentent, si bien que les créateurs doivent encore arbitrer avec soin. Le taux d'exploitabilité estimé pour cette vidéo tourne autour de 85 %.

Plan-séquence

Nous avons ensuite testé une séquence en un seul plan. Pour cela, nous avons conçu une scène de parkour au Maroc, en suivant un jeune homme à travers des toits, des rues, des ruelles, des maisons et des cours.

C'est un test utile, car une vidéo en plan-séquence ne peut pas masquer ses erreurs par le montage. Le modèle doit maintenir la continuité du personnage, du mouvement de caméra et des lieux du début à la fin. Il doit aussi transmettre vitesse et intensité tout en laissant le décor marocain clairement identifiable.

Résultat

Globalement, la vidéo a bien tenu le style du plan-séquence du début à la fin. Le cadre marocain était aussi bien rendu, avec ses toits, ses rues étroites, ses ruelles et son architecture traditionnelle qui rendaient le lieu évident.

Le principal problème venait de la course elle-même. À certains moments, le traceur ne bougeait pas comme une vraie personne. Ses appuis ne semblaient pas toujours bien ancrés au sol, et les réceptions manquaient du poids qu'on attend d'une vraie course ou d'un vrai saut. Par moments, ses pieds semblaient légèrement flotter au-dessus du sol, davantage comme un personnage de jeu vidéo que comme un vrai pratiquant de parkour.

Malgré cela, pour une scène rapide en plan-séquence avec autant de changements de lieux, le résultat restait solide. L'action gardait sa continuité, et l'atmosphère des rues marocaines ressortait bien.

Bilan d'exploitabilité

Si l'on regarde le taux d'exploitabilité des quatre vidéos, la première était proche de 100 %, avec seulement des erreurs de numéros de maillot. La deuxième était proche de 90 %, avec quelques erreurs de mouvement de caméra en plus des erreurs de numéros. La troisième tournait autour de 70 %. La quatrième approchait 95 %. Peu après la sortie de Seedance 2.0, certains ont affirmé que son taux d'exploitabilité pouvait atteindre 90 %. À la lumière de ces tests, cette affirmation ne semble pas particulièrement exagérée.

Test de suivi des instructions

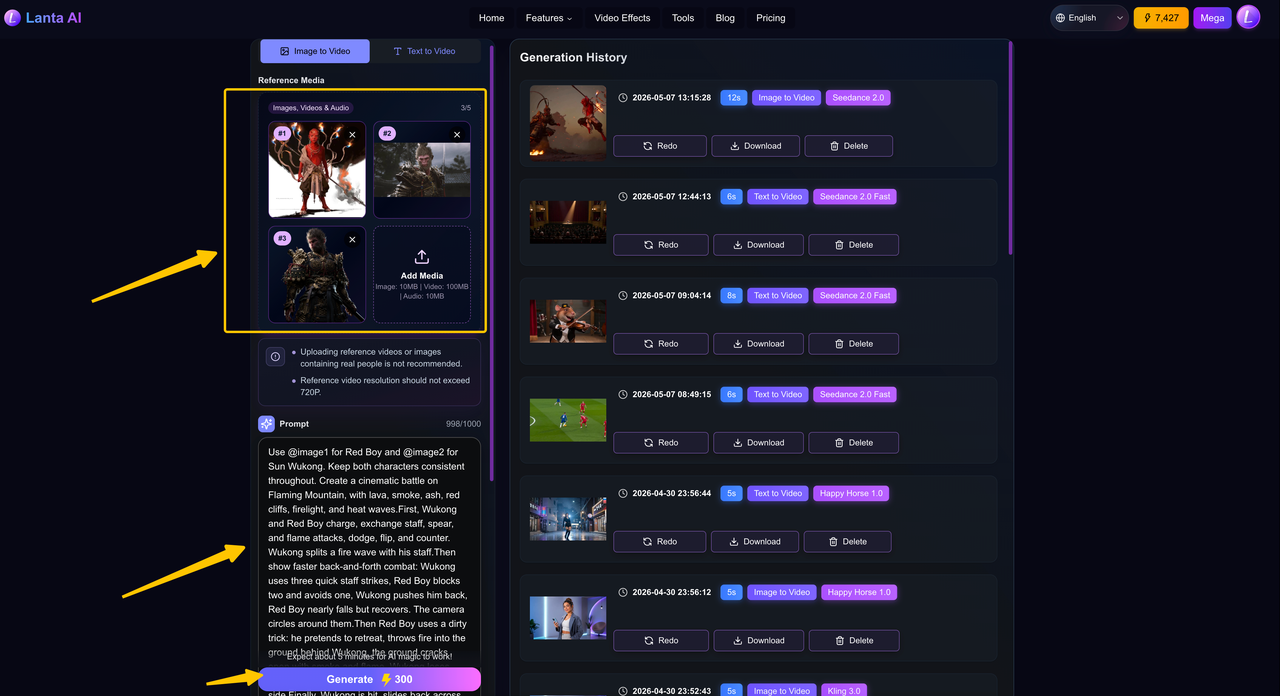

La suite portait sur le suivi des instructions. Cela demandait de rédiger des scripts très détaillés avec Gemini et de préparer à l'avance des références d'image complètes.

Comme la scène mettait en jeu Sun Wukong et Red Boy issus du jeu Black Myth, et qu'une seule IP était concernée, les exigences de référence visuelle et de fusion n'étaient pas particulièrement élevées. Le principal enjeu restait le suivi des instructions.

L'intrigue générale restait assez classique : Sun Wukong et Red Boy s'affrontent sur Flaming Mountain. Le combat bascule d'un côté puis de l'autre jusqu'à ce que Red Boy utilise une sale astuce pour mettre Sun Wukong au sol.

Résultat

L'ensemble de la vidéo était impressionnant. La charge de Red Boy, le maniement du bâton doré de Sun Wukong, le souffle de feu et le blocage de l'attaque par la force du héros rappelaient presque une production animée officielle.

La plus grande surprise venait de la qualité de l'action et du rendu visuel. Le modèle a très bien géré les décharges de pouvoir, les effets de feu, les attaques à grande échelle et les collisions d'énergie. Il a aussi capté de manière assez fidèle le style visuel de l'IP. Avec des prompts encore plus détaillés, le résultat pourrait sans doute aller plus loin.

Mais cette scène portait aussi de fortes exigences narratives. Le modèle est très bon sur le grand spectacle et les effets visuels, mais il peine davantage sur les petites nuances émotionnelles. Par exemple, il était difficile de montrer clairement un passage de l'arrogance à la peur. Cela est devenu l'une des limites principales de la vidéo finale.

Test des références multimodales

Nous avons ensuite testé les références multimodales. La première étape consistait à évaluer la capacité de Seedance 2.0 à s'appuyer sur de l'audio.

Le premier fichier audio utilisé était le refrain de Blue Bird. Nous avons fourni au modèle ce passage ainsi qu'une image de concert avec un public massif.

Le plus surprenant est que le modèle a pu créer ou restaurer du contenu par lui-même. Par exemple, les trois secondes précédant le chant n'avaient pas été fournies. Le modèle a prolongé cette partie tout seul. La mélodie correspondait à l'original, mais avec une ambiance de performance live.

Encore plus impressionnant, les mouvements de lèvres de la chanteuse correspondaient parfaitement à la chanson. Le seul regret est que le fichier fourni durait déjà presque 15 secondes. Une fois que le modèle a ajouté trois secondes en plus, il ne restait plus assez de temps et une ligne de la fin a été sautée.

Nous avons ensuite testé les références vidéo. C'est probablement l'endroit où l'on voit le mieux ce qui différencie Seedance 2.0. Générer des vidéos à partir d'effets sonores ou de musique n'est pas totalement nouveau. Par exemple, le modèle MoCha de Meta a déjà exploré des idées voisines.

Dans ce test, nous avons choisi une approche plus créative en remplaçant Levi par Zenitsu Agatsuma de Demon Slayer, que nous avons opposé au Titan Bestial. Comme les deux personnages ont des styles de combat très différents, nous n'avons pas cherché à recréer chaque mouvement complexe image par image. Nous nous sommes plutôt concentrés sur un geste signature clair : Thunder Breathing, First Form: Thunderclap and Flash.

Le résultat était étonnamment réussi. Le modèle a bien capté la sensation d'un petit personnage ultra-rapide affrontant un ennemi géant dans les airs, tout en montrant de forts effets de vent, des éclairs dorés, une ruée à grande vitesse et des impacts d'orage puissants. Il a même utilisé des gros plans sur le visage du Titan pour exprimer la surprise et la peur, tout en respectant la logique de l'action originale en faisant remonter Zenitsu le long de son bras jusqu'à la tête.

Dans notre test de référence vidéo, nous avons constaté que la vidéo guide mieux le modèle que les images fixes. Au lieu de simplement copier des éléments visuels, il peut suivre le rythme, le mouvement de caméra et le style d'action de la vidéo de référence. Il peut même recréer l'impression de styles d'anime ou de cinéma différents.

Cela dit, ce niveau de contrôle reste difficile à obtenir, et les résultats ne sont pas toujours constants. Quand la scène devient trop complexe, le modèle commence à toucher ses limites. Si le prompt contient trop d'informations ou trop de petites étapes logiques, il peut avoir du mal à tout suivre. Dans ces cas-là, il retombe souvent sur des montages rapides ou des fragments façon bande-annonce pour simplifier la tâche.

Même ainsi, les mélanges créatifs peuvent encore produire des résultats surprenants. Les détails ne sont pas toujours exacts, mais la capacité du modèle à créer des vidéos expressives et visuellement percutantes semble déjà assez forte pour un usage réel en production.

Limites de Seedance 2.0

Même si Seedance 2.0 a franchi un cap important en matière de contrôlabilité, il reste très loin d'un simulateur du monde vraiment parfait. Face à des concurrents comme Sora 2 et Google Veo 3.1, il ne domine pas sur tous les critères.

Les effets physiques complexes manquent encore de réalisme

Les modèles vidéo IA actuels semblent encore modéliser le monde physique davantage par appariement de motifs que par raisonnement à partir de premiers principes. Cela signifie qu'ils montrent encore des faiblesses lorsqu'ils doivent gérer des interactions physiques complexes ou peu courantes.

Par exemple, les simples éclaboussures d'eau générées par Seedance 2.0 peuvent déjà être convaincantes. En revanche, des flux liquides plus complexes, des plis et étirements de tissu en mouvement rapide, ou des mouvements fins de cheveux peuvent encore sembler rigides et moins réalistes.

Lorsqu'il faut gérer des collisions, des objets empilés ou des manipulations fines, Seedance 2.0 montre encore des comportements typiques de l'IA, comme le clipping, la lévitation ou des accélérations peu naturelles. Sa compréhension des relations spatiales, du contact entre objets et de la transmission des forces doit encore progresser.

La vidéo longue fait dériver les détails

Même si Seedance 2.0 garde une bonne cohérence dans une génération unique d'une dizaine de secondes, les problèmes commencent à apparaître dès que la vidéo s'allonge. À l'heure actuelle, tous les modèles vidéo restent confrontés au problème de l'érosion de mémoire.

Dans une vidéo narrative de plusieurs minutes, le modèle doit conserver dans le temps la cohérence des motivations des personnages, des détails de la scène et de l'état des objets. Cela demande une mémoire longue forte, ce qui reste difficile pour les modèles actuels. Pour l'instant, ce type de vidéo nécessite encore un montage manuel et une génération segmentée pour rester cohérent.

Dans certaines vidéos générées par des utilisateurs, même Seedance 2.0 peut montrer une légère dérive de texture ou du scintillement dans la seconde moitié du clip, surtout autour des motifs fins, du texte ou des détails d'arrière-plan.

Le réalisme pur en text-only peut rester en retrait

Par rapport à Sora 2 et Veo 3.1, Seedance 2.0 présente des avantages nets sur plusieurs plans, mais il a aussi ses faiblesses.

Sora et Veo semblent davantage chercher à simuler un monde réel, tandis que Seedance 2.0 se concentre davantage sur la construction d'un plateau contrôlable. Pour du contenu court nécessitant une sortie rapide et un très haut niveau de réalisme, la synchronisation audio-vidéo native de Veo 3.1 peut être un meilleur choix. En revanche, pour des créateurs professionnels qui ont besoin d'un contrôle fin sur l'interprétation des personnages, le langage de caméra et le style visuel, le workflow plus proche d'une logique de mise en scène proposé par Seedance 2.0 peut être plus séduisant.

Lorsqu'il s'agit de générer un contenu purement réaliste à partir du seul texte, sans références, Seedance 2.0 peut parfois être en retrait face à ses concurrents sur le réalisme humain et la subtilité de la lumière. Cela peut venir de choix différents dans la conception du modèle et dans la priorité donnée aux données d'entraînement.

Conclusion

Seedance 2.0 est devenu nettement plus fiable. Même lorsqu'une génération échoue, elle devient rarement totalement inutilisable. Il reste généralement des morceaux à conserver, à éditer ou à réutiliser. C'est important, car la question ne devient plus « peut-on utiliser la vidéo IA ? » mais plutôt « comment mieux l'utiliser ? »

Sa base la plus solide, c'est le storyboard. Quand le prompt est clair et que la densité d'information reste raisonnable, le modèle peut suivre des structures multi-plans, une logique d'action et des indications de caméra avec un bon niveau d'exécution. En revanche, son storytelling donne encore plus l'impression de bien terminer la tâche que de l'exprimer avec une véritable vision de mise en scène.

Seedance 2.0 impressionne aussi dans l'action, les VFX et la génération basée sur les références, en particulier lorsqu'on utilise des références visuelles ou vidéo pour fusionner des styles. Mais dès qu'une scène exige un contrôle émotionnel très fin, une forte densité narrative ou une intention précise image par image, le modèle a encore tendance à revenir vers des choix plus prudents.

Si vous voulez vous aussi tester la génération vidéo par IA, rendez-vous sur la page Seedance 2.0 de Lanta AI et commencez à créer dès aujourd'hui.