Seedance 2.0 hat uns beeindruckt, aber nicht aus dem Grund, den die meisten Demovideos nahelegen.

Der spannendste Punkt war nicht die reine Videoqualität. Es war die Kontrolle. In unseren Tests war Seedance 2.0 besser darin, Shot-Vorgaben zu befolgen, visuelle Referenzen zu nutzen und ein einfaches Storyboard in ein Video zu verwandeln, das eher geplant als zufällig wirkte.

Darin kommt Seedance 2.0 weiter als viele reine Prompt-to-Video-Modelle. Gleichzeitig zeigte das Modell aber auch Grenzen, die Creator nicht ignorieren sollten. Ein Test ließ die Kontrolle beeindruckend wirken. Ein anderer zeigte, wo sich die Physik noch künstlich anfühlt.

Wenn du weiterliest, siehst du klarer, was Seedance 2.0 gut kann, wo es auseinanderfällt und ob es für Video-Creator tatsächlich nützlich ist.

Was ist Seedance 2.0?

Seedance 2.0 ist ein KI-Videomodell von ByteDance Seed. Es hilft Creatorn, KI-Videos zu erzeugen, die sich besser steuern lassen, realistischer wirken und näher an realen Produktionsanforderungen liegen.

Anders als ein einfaches Text-to-Video-Modell kann es Text, Bilder, Videoclips und Audio als Referenzen nutzen. Dadurch lassen sich Motiv, Kamerabewegung, Stil, Rhythmus und Ton deutlich präziser führen.

From Seedance 1.0 to Seedance 2.0

| Version | Was neu dazu kam | Wie es der nächsten Version half |

|---|---|---|

Seedance 1.0 | Startete die Seedance-Videomodellreihe | Gab dem Modell die grundlegende Fähigkeit, kurze KI-Videoclips zu erzeugen |

Seedance 1.5 | Verbesserte die Audio-Video-Synchronität | Half dabei, Ton und Bild natürlicher zusammenwirken zu lassen |

Seedance 1.5 Pro | Verbesserte Image-to-Video und Audiogenerierung | Schuf eine stärkere Grundlage für hochwertigere und stabilere Videoausgabe |

Seedance 2.0Aktuell | Brachte Text, Bilder, Video und Audio in einen gemeinsamen Workflow | Vereinte Referenzen, Editing, Video-Fortsetzung, Multi-Shot-Generierung und nativen Ton zu einem vollständigeren KI-Video-Tool |

Stärken von Seedance 2.0

Seedance 2.0 fällt besonders in komplexen Szenen auf: Die Bewegungsstabilität ist stärker, und die physische Bewegung wirkt glaubwürdiger. Vor allem bei Interaktionen mit mehreren Personen und komplexen Bewegungsabläufen produziert das Modell mehr Clips, die Creator tatsächlich verwenden können.

In einer vollständigen Paarlauf-Sequenz im Eiskunstlauf kann das Modell zum Beispiel synchrone Sprünge, Rotationen in der Luft und präzise Landungen generieren und dabei von Anfang bis Ende eine physisch halbwegs glaubwürdige Bewegung halten. Das reduziert viele der Physikfehler, die in älteren KI-Videos häufig auftreten.

- Multimodale Referenzsteuerung. Nutzer können bis zu 9 Bilder, 3 Videoclips und 3 Audioclips zusammen mit natürlichsprachlichen Anweisungen eingeben. Das Modell kann diese Referenzen für Komposition, Bewegung, Kamerasprache, visuelle Effekte und Ton nutzen. Sogar textbasierte Storyboards lassen sich als kreative Referenz einsetzen.

- Mehr Kontrolle über das finale Video. Das Modell folgt Anweisungen besser, hält Konsistenz zuverlässiger, verlängert Videos stabiler und ermöglicht gezieltes Editing. Creator können präzise Änderungen an bestimmten Clips, Figuren, Aktionen oder Storylines vornehmen. Hinzu kommt eine promptgesteuerte Kameraplanung, die hilft, Shots mit klarerer Kamerabewegung, Bildkomposition und visuellem Fluss zu erzeugen.

- Stereo-Audiogenerierung mit zwei Kanälen. Es unterstützt gleichzeitige Mehrspur-Ausgabe, darunter Hintergrundmusik, Umgebungsgeräusche und Sprecheranteile. Diese Audioelemente lassen sich mit dem visuellen Rhythmus der Szene abstimmen, wodurch das fertige Video polierter, immersiver und professioneller getimt wirkt.

- Hochwertige 15-Sekunden-Multi-Shot-Ausgabe. In einem einzigen Durchlauf kann das Modell bis zu 15 Sekunden Multi-Shot-Video mit Ton erzeugen und gibt Creatorn damit mehr Raum, vollständige visuelle Momente zu bauen statt nur kurzer Bewegungsproben.

Storyboard- und Kamerabewegungstest

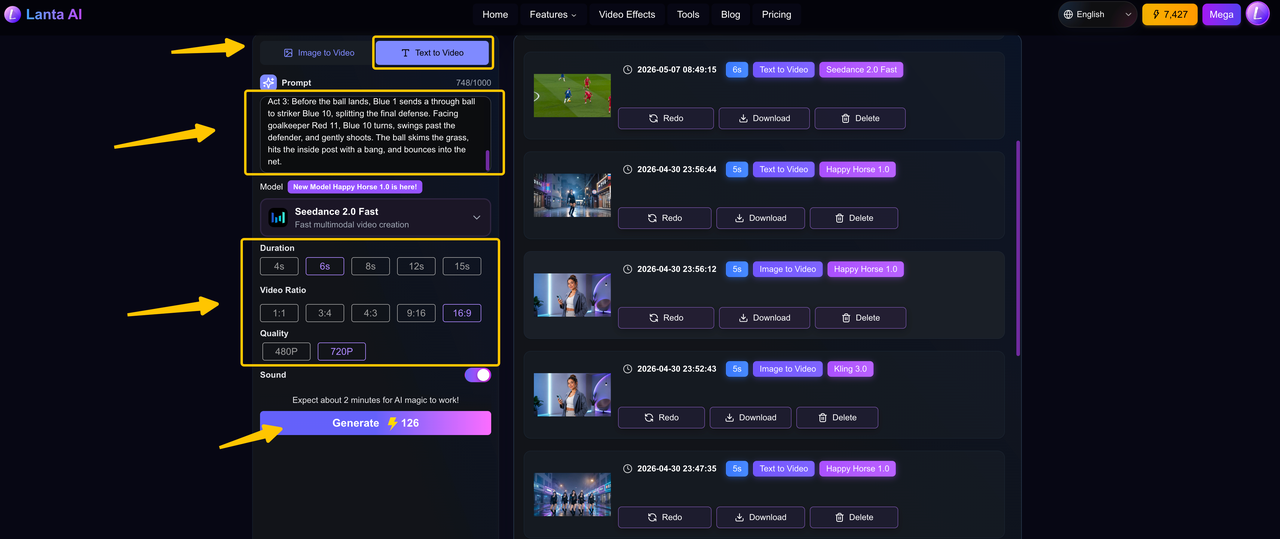

Wir haben mit einem Fußballspiel begonnen, weil es ein guter Test für Multi-Subject-Interaktion ist. Die Szene verlangt, dass das blaue Team fünf zusammenhängende Pässe spielt, durch die rote Abwehr kommt und am Ende trifft.

Auch wenn das kompliziert klingt, lässt sich die Aktion in klare Momente zerlegen. Ein Shot kann sich auf den ersten Pass konzentrieren, der nächste dem Empfänger folgen und ein weiterer die Reaktion der Verteidiger zeigen. Die Kamera muss mit Ball, Spielern und dem wechselnden Fokus des Spielzugs mithalten.

Im ersten Test gaben wir dem Modell weder ein detailliertes Storyboard noch konkrete Kameraanweisungen. Wir wollten erst sehen, wie gut es die Sequenz allein bewältigt, bevor wir mehr Kontrolle hinzufügen.

Erster Durchlauf ohne detaillierte Shot-Vorgaben

Football match. Blue team faces strong red defenders, completes five precise passes, then scores.

Act 1: Blue 8 is pressed by Red 3 and calmly passes to Blue 6. Blue 6 instantly sends a diagonal long ball to sprinting right winger Blue 7.

Act 2: Near the baseline, Blue 7 stops, cuts back to avoid Red 9's sliding tackle, then pushes the ball toward the penalty arc. Red 1 and Red 2 close in. Blue 7 flicks the ball through Red 2's legs back to the advancing Blue 1.

Act 3: Before the ball lands, Blue 1 sends a through ball to striker Blue 10, splitting the final defense. Facing goalkeeper Red 11, Blue 10 turns, swings past the defender, and gently shoots. The ball skims the grass, hits the inside post with a bang, and bounces into the net.Ergebnis

Insgesamt war das Videoergebnis gut. Die blaue Nummer 10 führte den finalen Abschluss tatsächlich aus, aber die gesamte Passfolge wurde nicht vollständig reproduziert. Statt fünf klar verbundenen Pässen waren nur ungefähr drei zu sehen.

Im mittleren Abschnitt wurden mehrere Aktionen, die ursprünglich der blauen Nummer 7 und der blauen Nummer 1 zugewiesen waren, stattdessen von der blauen Nummer 10 ausgeführt. Auch die Konfrontation zwischen der blauen Nummer 7 und den roten Verteidigern wurde nicht klar gezeigt, sodass dieser Teil weniger detailliert wirkte als im ursprünglichen Prompt beschrieben.

Trotzdem ist wichtig zu betonen, dass dies die erste Generation war. Wir haben nicht mehrere Versionen erzeugt und dann die beste herausgepickt. Schon auf Anhieb dieses Niveau zu erreichen, ist trotz der Fehler beeindruckend.

Storyboard und Kamerabewegung waren nicht falsch, aber ihnen fehlte ein eigener Stil. Das könnte die Art des Modells gewesen sein, bei einer Aufgabe mit hoher Informationsdichte auf Nummer sicher zu gehen.

Mit detaillierterem Storyboard und klarerer Kamerasprache

Danach wollten wir sehen, was passiert, wenn wir detailliertere Vorgaben zu Storyboard und Kamerabewegung hinzufügen.

In a football match, facing strong red-team players, the blue-team players complete five precise passes and finally score.

Act 1: Opening the Play - Passes 1-2

Shot 1 - Medium Shot: At the center of the frame, Blue No. 8 faces pressure from Red No. 3 and calmly passes the ball with the inside of his foot to Blue No. 6, who drops back to receive it.

Shot 2 - Wide Shot: After receiving the ball, Blue No. 6 does not hold onto it. He immediately sends a precise diagonal long pass. The ball draws a beautiful arc through the air and lands accurately at the feet of Blue No. 7, the right winger sprinting forward.

Act 2: Breaking Through the Defense - Passes 3-4

Shot 3 - Close-up / Tracking Shot: Near the baseline, Blue No. 7 suddenly stops and cuts the ball back, avoiding a sliding tackle from Red No. 9, then pushes the ball toward the top of the penalty arc.

Shot 4 - Low Angle: Two defenders, Red No. 1 and Red No. 2, move in to double-team him. Blue No. 7 lightly flicks the ball, sending it through Red No. 2's legs and back to Blue No. 1, who is rushing forward to complete the combination.Ergebnis

Diesmal folgte das Modell dem Prompt fast perfekt und zeigte tatsächlich seine Multi-Shot-Fähigkeit. Die Totale für den langen Pass funktionierte gut, weil sie die Ballbewegung leichter lesbar machte. Die nahe Tracking-Einstellung half ebenfalls dabei, die blaue Nummer 7 an der Grundlinie unter Gegnerdruck zu zeigen.

Perfekt war das Ergebnis trotzdem nicht. Einige Rückennummern blieben inkonsistent, und manche Aktionen wurden von den falschen Spielern ausgeführt. Auch das Doppeln durch die roten Nummern 1 und 2 war nicht besonders klar.

Für einen Prompt mit mehreren Spielern, mehreren Pässen und unterschiedlichen Shot-Typen war das Ergebnis dennoch stark. Es zeigt, dass das Modell eine grundlegende Multi-Shot-Sequenz versteht, auch wenn einzelne Details verloren gehen.

Cross-Cutting-Montage-Sequenz

Als Nächstes testeten wir eine Cross-Cutting-Montage-Sequenz. Diese Art von Storyboard eignet sich gut, um starken emotionalen oder narrativen Kontrast aufzubauen. Ein klassisches Beispiel ist die Taufsequenz in The Godfather, in der Michaels Teilnahme an der Zeremonie mit den Morden an den Oberhäuptern der Five Families gegengeschnitten wird.

Für diesen Test wählten wir eine humorvollere Konstellation: Eine Maus spielt auf der Bühne Musik, um das Publikum abzulenken, während ihre Gefährten die Gelegenheit zum Stehlen nutzen. Cross-Cutting ist eine natürliche Form, genau diesen Kontrast zu zeigen.

Ergebnis

Insgesamt war das Ergebnis ziemlich gut. Das Modell nutzte tatsächlich eine Cross-Cutting-Struktur und erzeugte erfolgreich ein Gefühl von Kontrast. Die Sequenz hätte noch besser funktioniert, wenn sie mehr Reaktionen aus dem Publikum enthalten hätte.

Unter hohem Informationsdruck steigen allerdings Fehler und ausgelassene Details, daher müssen Creator weiterhin sorgfältig abwägen. Die geschätzte Nutzbarkeit dieses Videos liegt bei etwa 85 %.

One-Shot-Sequenz

Danach testeten wir eine One-Shot-Sequenz. Dafür entwickelten wir eine Parkour-Szene in Marokko, in der ein junger Mann über Dächer, Straßen, Gassen, Häuser und Innenhöfe läuft.

Das ist ein sinnvoller Test, weil ein One-Shot-Video Fehler nicht durch Schnitte verstecken kann. Das Modell muss Figur, Kamerabewegung und Orte vom Anfang bis zum Ende zusammenhalten. Gleichzeitig muss die Bewegung schnell und aufregend wirken, ohne dass die marokkanische Stadt an Klarheit verliert.

Ergebnis

Insgesamt hielt das Video den One-Shot-Stil vom Anfang bis zum Ende gut durch. Auch das marokkanische Stadtsetting war überzeugend, mit Dächern, engen Straßen, Gassen und traditionellen Gebäuden, die den Ort klar erkennbar machten.

Das Hauptproblem war die Laufbewegung. In manchen Momenten bewegte sich der Parkour-Läufer nicht wie ein echter Mensch. Seine Schritte wirkten nicht immer sauber geerdet, und den Landungen fehlte das Gewicht, das man von echtem Laufen oder Springen erwarten würde. Teilweise schien es, als würden seine Füße leicht über dem Boden schweben, eher wie bei einer Videospielfigur als bei einem realen Parkour-Läufer.

Trotzdem war das Ergebnis für eine schnelle One-Shot-Szene mit so vielen Ortswechseln stark. Die Action blieb zusammenhängend, und die Atmosphäre der marokkanischen Straßen kam klar rüber.

Nutzbarkeits-Snapshot

Betrachtet man die Nutzbarkeitsrate der vier Videos zusammen, lag das erste fast bei 100 % und hatte nur Fehler bei den Trikotnummern. Das zweite lag nahe bei 90 %, mit einigen Kamerafehlern zusätzlich zu den Nummernfehlern. Das dritte lag bei rund 70 %. Das vierte kam fast auf 95 %. Kurz nach dem Release von Seedance 2.0 wurde behauptet, seine Nutzbarkeitsrate könne 90 % erreichen. Auf Basis dieser Tests wirkt diese Behauptung nicht übertrieben.

Instruction-Following-Test

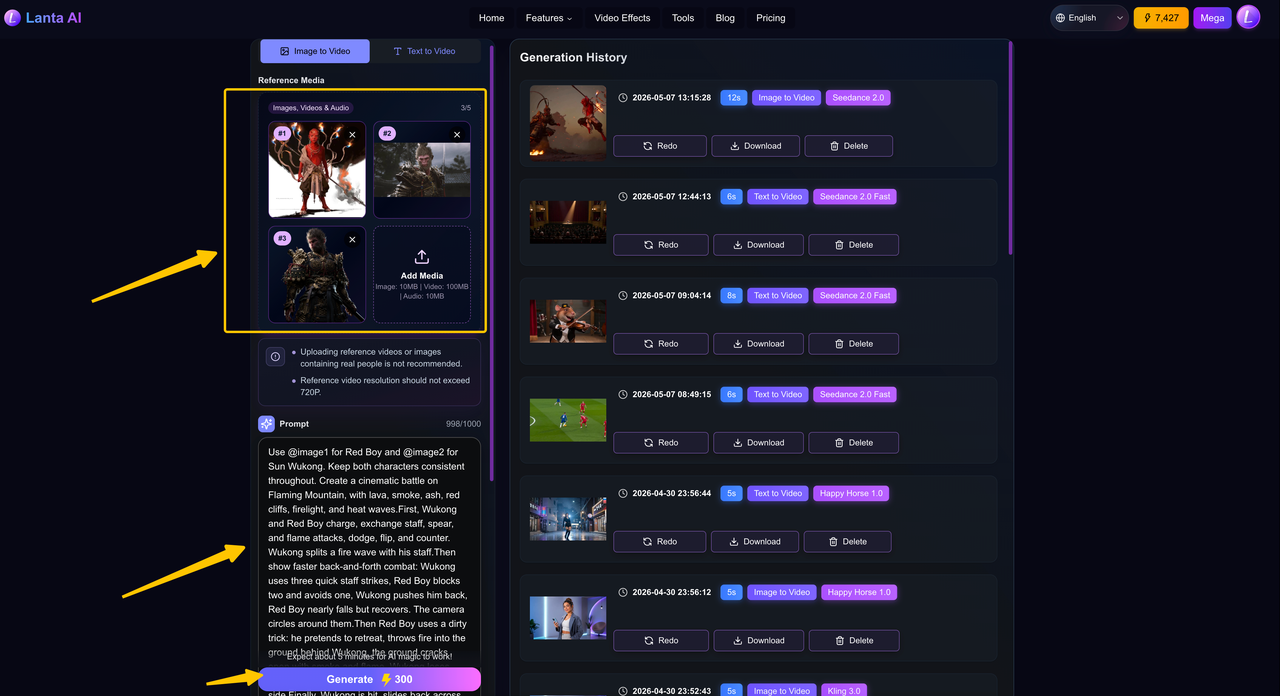

Als Nächstes kam der Instruction-Following-Test. Dafür mussten mit Gemini sehr detaillierte Skripte geschrieben und vollständige Bildreferenzen im Voraus vorbereitet werden.

Da die Szene Sun Wukong und Red Boy aus dem Spiel Black Myth betraf und nur eine einzige IP involviert war, waren die Anforderungen an Bildreferenz und Fusion nicht besonders hoch. Im Mittelpunkt stand vor allem das Befolgen von Anweisungen.

Die Handlung war insgesamt recht klassisch: Sun Wukong und Red Boy kämpfen auf dem Flaming Mountain. Der Kampf wogt hin und her, bis Red Boy einen schmutzigen Trick nutzt und Sun Wukong zu Boden bringt.

Ergebnis

Das gesamte Video sah beeindruckend aus. Red Boys Angriff, Sun Wukongs Schwung mit dem goldenen Stab, der Feuerstoß und die magische Abwehr des Angriffs fühlten sich fast wie eine offizielle Animationsproduktion an.

Die größte Überraschung waren die Action und die visuelle Qualität. Das Modell ging sehr gut mit magischen Energieausbrüchen, Feuereffekten, großflächigen Angriffen und Energiekollisionen um. Außerdem traf es den visuellen Stil der IP ziemlich genau. Mit noch detaillierteren Prompts ließe sich das Ergebnis vermutlich weiter steigern.

Gleichzeitig stellte die Szene hohe Anforderungen an das Storytelling. Das Modell war stark bei großem Spektakel und visuellen Effekten, tat sich aber mit feinen emotionalen Details schwerer. Ein klarer Wandel von Arroganz zu Angst ließ sich zum Beispiel kaum präzise darstellen. Genau das wurde zu einer der wichtigsten Grenzen des finalen Videos.

Test multimodaler Referenzen

Als Nächstes folgte der Test multimodaler Referenzen. Zuerst prüften wir, wie gut Seedance 2.0 mit Audioreferenzen arbeitet.

Die erste Audiodatei war der Refrain von Blue Bird. Wir gaben dem Modell diesen Abschnitt zusammen mit einem Bild eines Konzerts mit riesigem Publikum.

Am überraschendsten war, dass das Modell Inhalte selbstständig ergänzen oder wiederherstellen konnte. Die drei Sekunden vor dem eigentlichen Gesang stammten zum Beispiel nicht von uns. Das Modell verlängerte diesen Teil selbst. Die Melodie passte zum Originalsong, wurde aber in die Atmosphäre einer Live-Performance übersetzt.

Noch beeindruckender war, dass die Lippenbewegungen der Sängerin perfekt zum Song passten. Der einzige Wermutstropfen: Die von uns gelieferte Datei war schon fast 15 Sekunden lang. Nachdem das Modell weitere drei Sekunden ergänzt hatte, blieb nicht genug Zeit übrig, sodass am Ende eine Zeile ausfiel.

Danach testeten wir Videoreferenzen. Wahrscheinlich zeigt gerade dieser Bereich am deutlichsten, was Seedance 2.0 anders macht. Videos aus Soundeffekten oder Musik zu erzeugen, ist nicht völlig neu. Meta hat mit seinem MoCha-Modell ähnliche Ideen bereits erkundet.

In diesem Test gingen wir kreativer vor: Wir ersetzten Levi durch Zenitsu Agatsuma aus Demon Slayer und ließen ihn gegen den Beast Titan kämpfen. Da beide Figuren sehr unterschiedliche Kampfstile haben, versuchten wir nicht, jede komplexe Bewegung Frame für Frame nachzubauen. Stattdessen konzentrierten wir uns auf einen klar erkennbaren Signature-Move: Thunder Breathing, First Form: Thunderclap and Flash.

Das Ergebnis war überraschend beeindruckend. Das Modell traf das Gefühl eines kleinen, schnellen Charakters, der in der Luft gegen einen riesigen Gegner kämpft, und zeigte dabei starke Windeffekte, goldenes Blitzen, Hochgeschwindigkeitsbewegung und kraftvolle Einschläge. Es nutzte sogar Close-ups vom Gesicht des Beast Titan, um Schock und Angst zu zeigen, und folgte zugleich der Aktionslogik des Originals, indem Zenitsu am Arm des Titans Richtung Kopf entlangschoss.

In unserem Test mit Videoreferenzen stellten wir fest, dass Videoreferenzen das Modell besser lenken als Standbilder. Es kopiert nicht nur visuelle Elemente, sondern kann Rhythmus, Kamerabewegung und Actionstil des Referenzvideos übernehmen. Es kann sogar das Gefühl unterschiedlicher Anime- oder Filmstile nachbilden.

Trotzdem ist dieses Maß an Kontrolle weiterhin schwer zu erreichen, und die Ergebnisse sind nicht immer konsistent. Wenn die Szene zu komplex wird, stößt das Modell an seine Grenzen. Wenn der Prompt zu viele Informationen oder zu viele kleine logische Schritte enthält, fällt es ihm schwer, alles gleichzeitig zu befolgen. Dann zieht es sich oft auf schnelle Montagen oder trailerartige Fragmente zurück, um die Aufgabe zu vereinfachen.

Trotzdem können kreative Mischungen weiterhin überraschende Resultate liefern. Die Details sind nicht immer exakt, aber die Fähigkeit des Modells, expressive und visuell aufregende Videos zu erzeugen, fühlt sich bereits stark genug für echte Produktionsarbeit an.

Grenzen von Seedance 2.0

Auch wenn Seedance 2.0 bei der Kontrollierbarkeit einen großen Schritt nach vorn gemacht hat, ist das Modell noch weit von einem perfekten Weltsimulator entfernt. Gegenüber Konkurrenten wie Sora 2 und Google Veo 3.1 führt Seedance 2.0 nicht in jedem Bereich.

Komplexe Physikeffekte wirken noch nicht real genug

Aktuelle KI-Videomodelle scheinen die physische Welt noch immer eher über Musterabgleich als über Prinzipienverständnis zu modellieren. Deshalb zeigen sie bei komplexen oder ungewöhnlichen physikalischen Interaktionen weiterhin Schwächen.

Einfache Wasserspritzer aus Seedance 2.0 können schon ordentlich aussehen. Bei komplexeren Flüssigkeitsströmen, Falten und Dehnung von Stoff in schneller Bewegung oder subtiler Haarbewegung kann das Ergebnis aber weiterhin steif und weniger realistisch wirken.

Bei Kollisionen, gestapelten Objekten oder feiner Objektmanipulation zeigt Seedance 2.0 nach wie vor typische KI-Macken wie Clipping, Schweben oder unnatürliche Beschleunigung. Das Verständnis für räumliche Beziehungen, Objektkontakt und die Weitergabe von Kräften zwischen Objekten muss noch besser werden.

In langen Videos driften Details leichter weg

Obwohl Seedance 2.0 innerhalb einer einzelnen Generation von etwa zehn Sekunden eine gute Kohärenz halten kann, tauchen mit längerer Dauer zunehmend Probleme auf. Derzeit kämpfen alle Videomodelle weiterhin mit einem Effekt, den man als Memory Decay beschreiben kann.

In einem narrativen Video von mehreren Minuten muss das Modell Motivation der Figuren, Szenendetails und Objektzustände über längere Zeit konsistent halten. Das erfordert ein starkes Langzeitgedächtnis, und genau das ist für aktuelle Videomodelle weiterhin schwierig. Solche Videos brauchen deshalb im Moment nach wie vor manuelles Editing und segmentierte Generierung, um kohärent zu bleiben.

In einigen nutzergenerierten Videos kann selbst Seedance 2.0 in der zweiten Hälfte des Clips leichte Texture Drifts oder Flackern zeigen, besonders bei feinen Mustern, Text oder Hintergrunddetails.

Rein realistischer Text-only-Output kann hinter Wettbewerbern zurückfallen

Im Vergleich zu Sora 2 und Veo 3.1 hat Seedance 2.0 in mehreren Bereichen klare Vorteile, aber eben auch Schwächen.

Sora und Veo scheinen stärker darauf ausgerichtet zu sein, eine reale Welt zu simulieren, während Seedance 2.0 eher darauf setzt, ein kontrollierbares Set zu bauen. Für kurze Inhalte, bei denen schneller Output und sehr hoher Realismus gefragt sind, kann Veo 3.1 mit seiner nativen Audio-Video-Synchronität die bessere Wahl sein. Für professionelle Creator, die feine Kontrolle über Charakter-Performance, Kamerasprache und visuellen Stil brauchen, kann der stärker regieähnliche Workflow von Seedance 2.0 attraktiver sein.

Wenn rein realistischer Content nur aus Text und ohne Referenzen erzeugt werden soll, kann Seedance 2.0 bei menschlichem Realismus und subtilen Lichtdetails manchmal hinter Wettbewerbern zurückliegen. Das könnte an unterschiedlichen Modellentscheidungen und Trainingsschwerpunkten liegen.

Fazit

Seedance 2.0 ist deutlich verlässlicher geworden. Selbst wenn eine Generation scheitert, ist sie nur selten komplett unbrauchbar. Meist bleiben Teile übrig, die man behalten, weiterbearbeiten oder wiederverwenden kann. Das ist wichtig, weil die Frage dadurch von «Kann man KI-Video überhaupt nutzen?» zu «Wie nutzt man es besser?» verschoben wird.

Seine stärkste Grundlage ist das Storyboarding. Wenn der Prompt klar ist und die Informationsdichte im Rahmen bleibt, kann das Modell Multi-Shot-Strukturen, Actionlogik und Kameraanweisungen mit hoher Vollständigkeit umsetzen. Sein Storytelling fühlt sich aber noch eher wie korrektes Abarbeiten als wie eine starke Regiehandschrift an.

Seedance 2.0 ist auch bei Action, VFX und referenzbasierter Generierung stark, besonders wenn visuelle oder videobasierte Referenzen zur Stilfusion genutzt werden. Sobald eine Szene jedoch sehr feine emotionale Kontrolle, dichte narrative Bedeutung oder präzise Frame-für-Frame-Absicht verlangt, greift das Modell weiterhin gern auf sicherere Lösungen zurück.

Wenn du KI-Videogenerierung selbst ausprobieren willst, besuche die Seedance-2.0-Seite auf Lanta AI und leg direkt los.